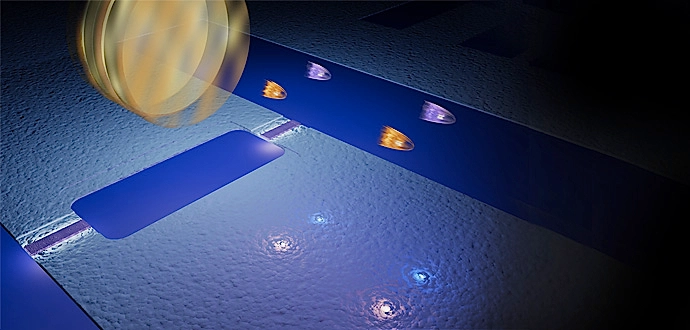

Επιστήμονες ανέπτυξαν ένα σύστημα τεχνητής νοημοσύνης ικανό να διαβάζει τις σκέψεις των ανθρώπων μετρώντας την εγκεφαλική δραστηριότητα και μετατρέποντάς την σε κείμενο – μια εξέλιξη που προκαλεί ανησυχίες για την ιδιωτικότητα και την ελευθερία.

Η μελέτη (pdf), που δημοσιεύθηκε στο περιοδικό Nature Neuroscience την 1η Μαΐου, χρησιμοποίησε ένα μοντέλο μετασχηματιστή, παρόμοιο με αυτό που τροφοδοτεί το chatbot τεχνητής νοημοσύνης ChatGPT της OpenAI, για να αποκωδικοποιήσει τις σκέψεις των ανθρώπων. Ένα μοντέλο μετασχηματιστή είναι ένα νευρωνικό δίκτυο που μαθαίνει τα συμφραζόμενα, και συνεπώς το νόημα. Ο μετασχηματιστής άκουσε αρχικά κάποιες ώρες podcast και η εγκεφαλική δραστηριότητα καταγράφηκε. Στη συνέχεια οι ερευνητές εκπαίδευσαν τον αποκωδικοποιητή σε αυτές τις καταγραφές. Αργότερα, τα υποκείμενα άκουσαν μια νέα ιστορία ή φαντάστηκαν να λένε μια ιστορία, γεγονός που επέτρεψε στον αποκωδικοποιητή να δημιουργήσει το αντίστοιχο κείμενο αναλύοντας την εγκεφαλική δραστηριότητα.

Οι ερευνητές εκπαίδευσαν τους αποκωδικοποιητές σε τρία υποκείμενα. «Επειδή ο αποκωδικοποιητής μας αναπαριστά τη γλώσσα χρησιμοποιώντας σημασιολογικά χαρακτηριστικά και όχι κινητικά ή ακουστικά χαρακτηριστικά, οι προβλέψεις του αποκωδικοποιητή θα πρέπει να αποτυπώνουν το νόημα των ερεθισμάτων», αναφέρεται στη μελέτη.

«Τα αποτελέσματα δείχνουν ότι οι αποκωδικοποιημένες ακολουθίες λέξεων κατέλαβαν όχι μόνο το νόημα των ερεθισμάτων, αλλά συχνά ακόμη και ακριβείς λέξεις και φράσεις».

Οι τεχνολογίες που είναι ικανές να διαβάζουν τις σκέψεις των ανθρώπων μπορεί να είναι ευεργετικές για τα άτομα που έχουν χάσει την ικανότητά τους να επικοινωνούν σωματικά. Ωστόσο, εγείρουν ανησυχίες σχετικά με την προστασία της ιδιωτικής ζωής και την απώλεια της ελευθερίας.

Σε συνέντευξή της στο MIT Technology Review στις 17 Μαρτίου, η Νίτα Φαραχάνι, μελλοντολόγος και νομικός ηθικολόγος στο Πανεπιστήμιο Duke στο Durham της Βόρειας Καρολίνας, προειδοποίησε ότι η συλλογή εγκεφαλικών δεδομένων μπορεί να χρησιμοποιηθεί από κυβερνήσεις και άλλες δυνάμεις για κακόβουλους σκοπούς.

«Μια αυταρχική κυβέρνηση που έχει πρόσβαση σε αυτά θα μπορούσε να τα χρησιμοποιήσει για να προσπαθήσει να εντοπίσει ανθρώπους που δεν δείχνουν πολιτική προσήλωση, για παράδειγμα. Αυτή είναι μια πολύ γρήγορη και σοβαρή κατάχρηση των δεδομένων. Ή να προσπαθήσει να εντοπίσει ανθρώπους που είναι νευροτυπικοί και να κάνει διακρίσεις ή να τους διαχωρίσει», δήλωσε η Φαραχάνι.

Σε έναν εργασιακό χώρο, η τεχνολογία μπορεί να χρησιμοποιηθεί στην «απανθρωποποίηση» των εργαζομένων, αναγκάζοντάς τους να υποβληθούν σε νευροεπιτήρηση.

Ακολουθήστε μας στο Telegram @epochtimesgreece

Ακολουθήστε μας στο Facebook @epochtimesgreece

Ακολουθήστε μας στο Twitter @epochtimesgreece