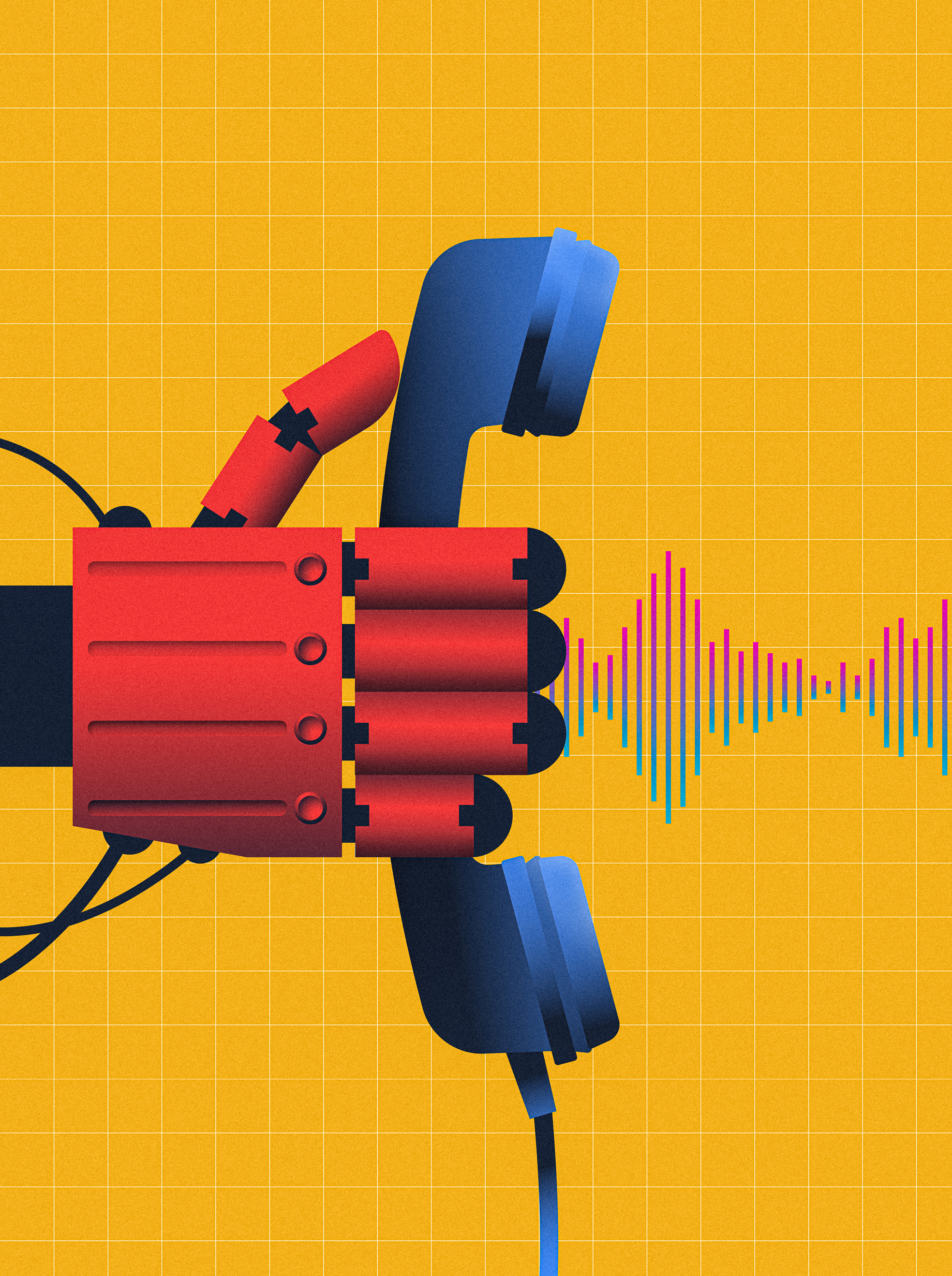

Το ηλεκτρονικό ψάρεμα (phishing), το οποίο ήδη από τη δεκαετία του 1990 χρησιμοποιούσε ψεύτικα email για να εξαπατήσει ανυποψίαστα θύματα, εξελίχθηκε στη χρήση ψεύτικων SMS (μηνυμάτων κειμένου στο κινητό τηλέφωνο), γνωστά ως επιθέσεις smishing. Τώρα, αυτού του είδους οι απάτες έχουν εισέλθει σε ένα νέο στάδιο, με επιθέσεις φωνητικού ηλεκτρονικού ψαρέματος (phishing) ή vishing που περιλαμβάνουν κλωνοποίηση φωνής.

Μια μέθοδος είναι η αποστολή ενός μηνύματος φωνητικού ταχυδρομείου που δημιουργείται από τεχνητή νοημοσύνη (AI), που μιμείται το παιδί ή το εγγόνι σας και ακούγεται πανικόβλητο, σε ένα μέλος της οικογένειας, ζητώντας χρήματα, συχνά μέσω ενός ψεύτικου τραπεζικού συνδέσμου.

«Το καθημερινό σενάριο vishing είναι ένα τηλεφώνημα υψηλής πίεσης, ‘επείγοντος προβλήματος’», δήλωσε στην Epoch Times ο Νέιθαν Χάους, Διευθύνων Σύμβουλος της StationX, μιας πλατφόρμας εκπαίδευσης στον κυβερνοχώρο με έδρα το Ηνωμένο Βασίλειο.

«Ο καλών πλαστογραφεί τον αριθμό της τράπεζάς σας, ισχυρίζεται ότι ο λογαριασμός σας έχει παραβιαστεί και χρειάζεται να ‘επαληθεύσετε’ έναν κωδικό πρόσβασης μιας χρήσης που μόλις έστειλε σε μήνυμα — στην πραγματικότητα τον πραγματικό σας κωδικό δύο παραγόντων», πρόσθεσε.

«Άλλες παραλλαγές μιμούνται την αστυνομία, τις εταιρείες κοινής ωφέλειας ή έναν πανικόβλητο συγγενή που απαιτεί χρήματα έκτακτης ανάγκης. Τα χαρακτηριστικά είναι ένα αξιόπιστο όνομα στην αναγνώριση καλούντος, μια συναισθηματική ή οικονομική απειλή και το αίτημα για άμεση δράση — συνήθως η κοινοποίηση διαπιστευτηρίων, η ανάγνωση ενός κωδικού ή η μεταφορά χρημάτων», εξήγησε ο Χάους.

Η Γιουργκίτα Λαπιενίτε, αρχισυντάκτρια του Cyber News, μιας έκδοσης με έδρα τη Λιθουανία που επικεντρώνεται στην κυβερνοασφάλεια, τόνισε την αυξανόμενη διάδοση του vishing.

Προειδοποίησε ότι ενώ η τρέχουσα τεχνολογία κλωνοποίησης φωνής μέσω τεχνητής νοημοσύνης είναι σε θέση να κολλήσει μόνο σε ένα σενάριο και δεν μπορεί να αντιδράσει αυθόρμητα σε ερωτήσεις ή απαντήσεις σε πραγματικό χρόνο, «είναι μόνο θέμα χρόνου μέχρι να μάθει να είναι περισσότερο σαν εμάς και να μπορεί να χρησιμοποιηθεί ως όπλο εναντίον μας».

«Αν νιώθω ότι μιλάω πραγματικά με έναν συγγενή μου, θα είμαι πιο πρόθυμη να του δανείσω χρήματα, επειδή είμαι πεπεισμένη ότι αυτό είναι το πραγματικό άτομο με το οποίο μιλάω – και αυτό είναι πραγματικά επικίνδυνο», επεσήμανε.

Η ετήσια έκθεση για το κυβερνοέγκλημα του Κέντρου Παραπόνων για το Διαδίκτυο (IC3) του FBI, που δημοσιεύθηκε στις 23 Απριλίου, ανέφερε ότι το 2024 είχε λάβει 193.407 καταγγελίες για ηλεκτρονικό ψάρεμα (phishing) ή spoofing (μια τεχνική κατά την οποία οι απατεώνες καλύπτουν τους δικούς τους αριθμούς τηλεφώνου και ξεγελούν τα θύματα κάνοντάς τα να νομίζουν ότι λαμβάνουν μια γνήσια κλήση). Αυτό το κατέστησε τον πιο διαδεδομένο τύπο απάτης, σε σύγκριση με 86.415 καταγγελίας για εκβιασμό και 441 για κακόβουλο λογισμικό.

Ο Χάους είπε ότι η έκθεση του FBI δείχνει πόσο διαδεδομένο είναι το πρόβλημα του ηλεκτρονικού ψαρέματος (phishing) και της πλαστογράφησης.

«Το ηλεκτρονικό ψάρεμα (phishing), η πλαστογράφηση και οι παραφυάδες τους — φωνητικό ηλεκτρονικό ψάρεμα ή vishing, smishing, QR-phishing — αποτελούν τα βασικά εργαλεία του κυβερνοεγκλήματος εδώ και χρόνια, επειδή είναι φθηνά στην εκτέλεση και κλιμακώνονται σε εκατομμύρια στόχους σχεδόν χωρίς τεχνικές δεξιότητες», είπε.

Η Λαπιενίτε είπε ότι γίνεται όλο και φθηνότερο να εξαπατάς ανθρώπους χρησιμοποιώντας κλωνοποίηση φωνής. «Το 2020, αν ήθελες να κλωνοποιήσεις μια φωνή, θα χρειαζόσουν πιθανώς περίπου 20 λεπτά ηχογράφησης», είπε.

«Στις μέρες μας, με την τεχνητή νοημοσύνη, τον αυτοματισμό και άλλες άλλες καινοτομίες, χρειάζεσαι μόνο μερικά δευτερόλεπτα από τη φωνή κάποιου, και μπορείς να πλαστογραφήσεις τη φωνή του και να κάνεις μια ηχογράφηση να ακούγεται σαν να προέρχεται όντως από εκείνο το άτομο.»

Η Χάους είπε ότι οι απατεώνες χρειάζονται μόνο λίγα δευτερόλεπτα ήχου για να δημιουργήσουν ένα πειστικό αντίγραφο χρησιμοποιώντας εργαλεία κλωνοποίησης φωνής με τεχνητή νοημοσύνη, «ας πούμε, ένα κλιπ TikTok ή μια σύντομη κλήση σε λάθος αριθμό».

«Αυτό μειώνει δραματικά το φράγμα κόστους και δεξιοτήτων», είπε. «Οι εγκληματίες δεν χρειάζονται πλέον δείγματα ποιότητας στούντιο ή μακροσκελείς ηχογραφήσεις. Έτσι, μπορούν να συλλέγουν αποσπάσματα που δημοσιεύονται στο διαδίκτυο, να τα τροφοδοτούν σε μια δωρεάν μηχανή κλωνοποίησης και να ξεκινούν τις κλήσεις.»

Σύμφωνα με το IC3, άτομα άνω των 60 ετών υπέστησαν απώλειες σχεδόν 5 δισεκατομμυρίων δολαρίων από το κυβερνοέγκλημα το 2024. Ήταν αυτοί που υπέβαλαν τις περισσότερες καταγγελίες στην υπηρεσία.

Και θα μπορούσε να γίνει πολύ χειρότερο — το Κέντρο Χρηματοοικονομικών Υπηρεσιών της Deloitte ανέφερε σε έκθεση που δημοσιεύτηκε τον Μάιο του 2024 ότι οι οικονομικές απώλειες λόγω εξαπάτησης με τεχνητή νοημοσύνη θα μπορούσαν να φτάσουν τα 40 δισεκατομμύρια δολάρια, στις Ηνωμένες Πολιτείες, έως το 2027.

Τον Μάιο του 2023, ο Τεγιάι Φλέτσερ, 35 ετών, φυλακίστηκε για 13 χρόνια και τέσσερις μήνες από δικαστή στο Λονδίνο για τον ρόλο του στη λειτουργία του iSpoof, μίας ιστοσελίδας που προμήθευσε με λογισμικό απατεώνες που αφαίρεσαν περίπου 43 εκατομμύρια λίρες (~50 εκατομμύρια ευρώ) από κατοίκους της Βρετανίας και ένα μεγάλο, απροσδιόριστο ποσό θυμάτων στις Ηνωμένες Πολιτείες.

Οι απατεώνες αγόρασαν λογισμικό πλαστογράφησης, όπως το Interactive Voice Response (IVR), από την ιστοσελίδα, το οποίο απέφερε 112,6 Bitcoin (1,08 εκατομμύρια δολάρια) στον Φλέτσερ και τους συνεργάτες του.

Το 2019, η Wall Street Journal ανέφερε ότι μια απάτη με ψευδή φωνή εξαπάτησε στέλεχος βρετανικής εταιρείας ενέργειας ώστε να μεταφέρει 220.000 ευρώ, αφού τον έπεισε ότι μιλούσε με τον προϊστάμενό του στη Γερμανία.

«Οι ληστείες με ψευδή φωνή δεν πολυαναφέρονται στις ειδήσεις, αλλά σχεδόν σίγουρα δεν αναφέρονται επαρκώς επειδή οι εταιρείες φοβούνται το πλήγμα στη φήμη τους», δήλωσε ο Χάους.

«Μόνο λίγες έχουν εμφανιστεί δημόσια, ωστόσο οι απώλειες από παραβιάσεις email επιχειρήσεων — στις οποίες εντάσσονται αυτές οι απάτες με ψευδή φωνή του CEO — μετρώνται ήδη σε δισεκατομμύρια κάθε χρόνο. Είναι πιθανό η εξαπάτηση με ψευδή φωνή να έχει αποσπάσει πολλά εκατομμύρια συνολικά», πρόσθεσε.

Ο Χάους δήλωσε ότι τα περισσότερα περιστατικά καταγράφηκαν ως απάτες μέσω τραπεζικών εμβασμάτων.

Η Λαπιενίτε συμφώνησε ότι υπάρχει ανεπαρκής αναφορά για ψευδή φωνή και άλλες απάτες, ειδικά μεταξύ των ηλικιωμένων που συχνά ντρέπονται να παραδεχτούν ότι έχουν πέσει θύμα εξαπάτησης, «επειδή αισθάνονται μοναξιά και δεν θέλουν να τους γελοιοποιούν».

Ο διευθυντής του FBI, Κας Πατέλ, δήλωσε σε δήλωσή του που δημοσιεύτηκε στις 23 Απριλίου: «Η αναφορά είναι ένα από τα πρώτα και πιο σημαντικά βήματα στην καταπολέμηση του εγκλήματος, ώστε οι αρχές επιβολής του νόμου να μπορούν να χρησιμοποιήσουν αυτές τις πληροφορίες για την καταπολέμηση διαφόρων τύπων απάτης.»

«Είναι επιτακτική ανάγκη το κοινό να αναφέρει αμέσως στο FBI κάθε ύποπτη εγκληματική δραστηριότητα κυβερνοασφάλειας», πρόσθεσε.

Κινεζικά συνδικάτα οργανωμένου εγκλήματος, όπως η συμμορία 14K, έχουν κατασκευάσει τα τελευταία χρόνια μεγάλης κλίμακας κόμβους κυβερνοαπάτης στην Καμπότζη, το Λάος και τη Βιρμανία (γνωστή και ως Μιανμάρ), οι οποίοι στοχεύουν Αμερικανούς.

Η Έριν Γουέστ, πρώην εισαγγελέας που τώρα διευθύνει την Επιχείρηση Shamrock, επιδιώκει να επισημάνει την απειλή από τη βιομηχανία απάτης στον κυβερνοχώρο. Δήλωσε ότι τις συμμορίες «πρέπει να τις φοβόμαστε στο επίπεδο οποιουδήποτε κακόβουλου έθνους-κράτους».

«Είναι τόσο μεγάλες. είναι τόσο οργανωμένες. είναι τόσο καλά χρηματοδοτούμενες», δήλωσε στην Epoch Times σε πρόσφατη συνέντευξή της.

Η Λαπιενίτε είπε επίσης ότι η βιομηχανία απάτης στον κυβερνοχώρο της Νοτιοανατολικής Ασίας είναι πλέον πιο πιθανό να διεξάγει επιθέσεις vishing μεγάλης κλίμακας, αντί να κυνηγάει απλώς τα «μεγάλα ψάρια».

Είπε ότι ενώ οι απατεώνες μπορεί να στοχεύουν τους ηλικιωμένους και όσους ζουν μόνοι, οι στόχοι συχνά επιλέγονται τυχαία.

«Θα μπορούσε να είναι οποιοσδήποτε. Οι απατεώνες έχουν επίσης τις αγαπημένες τους ώρες για να χτυπούν, κατά τη διάρκεια των διακοπών ή τα πρωινά, όταν οι άνθρωποι είναι πιο χαλαροί ή δεν σκέφτονται καθαρά», είπε η Λαπιενίτε.

Πρόσθεσε ότι οι ηλικιωμένοι συχνά γίνονται στόχος απατεώνων ερωτικών σχέσεων.

«Στις απάτες ερωτικών σχέσεων, χτίζουν μια εντελώς νέα περσόνα. Έτσι, σίγουρα μπορούν να μιμειθούν μια φωνή, αλλά νομίζω ότι είναι πιο επικίνδυνο όταν καταφέρνουν να μιμηθούν τη φωνή κάποιου που γνωρίζετε… είναι πολύ πιο προσωπικό».

Η Λαπιενίτε είπε ότι η κλωνοποίηση φωνής παρουσίαζε επίσης κινδύνους για τα μέσα ενημέρωσης.

Την περασμένη εβδομάδα, το βρετανικό περιοδικό Press Gazette ανέφερε ότι πολλά μέσα ενημέρωσης, συμπεριλαμβανομένου του Yahoo News, διέγραψαν άρθρα λόγω φόβων ότι οι λεγόμενοι ειδικοί που είχαν πάρει συνέντευξη ήταν ρομπότ που δημιουργήθηκαν από την τεχνητή νοημοσύνη.

«Προ τεχνητής νοημοσύνης, επαληθεύατε ότι το άτομο είναι άτομο. Θα τους καλούσατε, θα συζητούσατε λίγο – θα γνωρίζατε αν μιλάτε με κάποιον άνθρωπο», είπε η Λαπιενίτε, προσθέτοντας ότι η τεχνητή νοημοσύνη είναι πλέον σε θέση να πλαστογραφήσει βίντεο καθώς και φωνές, γεγονός που καθιστά πιο δύσκολο να επαληθευτεί πλέον εάν πράγματι μιλάτε με έναν άνθρωπο.

Ενώ η τεχνητή νοημοσύνη βελτιώνεται καθημερινά, το λογισμικό κλωνοποίησης φωνής δεν είναι ακόμα σε θέση να μιμηθεί τέλεια τους ανθρώπους και συχνά ακούγεται ρομποτικό ή δεν έχει αίσθηση του χιούμορ, επισημαίνει η Λιαπενίτε, παρατηρώντας ότι απουσιάζουν οι παύσεις, τα γλωσσικά ολισθήματα και οι ημιτελείς προτάσεις που κάνει ένας άνθρωπος όταν μιλάει.

«Αλλά θα φτάσουν εκεί, νομίζω, γρήγορα, και τότε θα είναι πραγματικά τρομακτικό», είπε η Λαπιενίτε.

Η Starling Bank, μια βρετανική τράπεζα που αμφισβητεί την ψηφιακή τεχνολογία, παρήγαγε μια ταινία στο YouTube τον Σεπτέμβριο του 2024, στην οποία ο ηθοποιός Τζέημς Νέσμπιτ προειδοποιεί για την άνοδο της εξαπάτησης με κλωνοποίησης φωνής, λέγοντας: «Η απάτη κλωνοποίησης φωνής μέσω τεχνητής νοημοσύνης βρίσκεται σε άνοδο και ο καθένας μπορεί να γίνει θύμα».

Εν συνεχεία, προτείνει στους ανθρώπους να χρησιμοποιήσουν μια ασφαλή φράση, όπως ένα «οικογενειακό αστείο», για να ελέγξουν ότι μιλάνε πραγματικά με τον συγγενή ή τον φίλο που πιστεύουν ότι βρίσκεται στην άλλη άκρη του τηλεφώνου.

Ο Χάους συμφωνεί ότι η χρήση μίας κωδικής λέξης – ενός συνθήματος – μεταξύ των μελών της οικογένειας «είναι μία απλή, αποτελεσματική μέθοδος επιβεβαίωσης».

«Αν κάποιος που ακούγεται σαν τον γιο σας σας καλέσει παρακαλώντας για χρήματα, ζητήστε να σας πει τη συμφωνημένη φράση — κάτι που κανένας ξένος δεν θα μπορούσε να μαντέψει. Αυτό αναγκάζει τον απατεώνα να χαλάσει τον χαρακτήρα ή να κλείσει το τηλέφωνο», είπε.

Είπε ότι δεν είναι αλάνθαστο, αλλά είναι μια άμυνα χαμηλής τεχνολογίας που θα μπορούσε να αποδυναμώσει δραματικά τις απάτες κλωνοποίησης φωνής.

Η Λαπιενίτε επεσήμανε το αδύναμο σημείο των ανθρώπων που πέφτουν θύματα: «Το πρόβλημα είναι ότι όταν σας καλεί κάποιος κοντινός σας, δεν προσπαθείτε να επαληθεύσετε την ταυτότητά του. Δεν στήνετε προστατευτικές ασπίδες, [δεν αναρωτιέστε:] ‘με καλεί πραγματικά η μαμά μου;’ Και, ξέρετε, δεν θα ήθελα να ζήσω σε έναν τέτοιο κόσμο», πρόσθεσε.

Ο Χάους είπε ότι οι τράπεζες και άλλοι χρηματοπιστωτικοί οργανισμοί θα μπορούσαν να κάνουν πολύ περισσότερα για να αντιμετωπίσουν την πλαστογράφηση και τις άπατες.

«Οι τράπεζες θα πρέπει να απαιτούν επιβεβαίωση εκτός ζώνης — επανακλήσεις σε γνωστό αριθμό — πριν από οποιαδήποτε μεταφορά υψηλής αξίας και να μην βασίζονται ποτέ μόνο στη φωνή», είπε.

Πρόσθεσε ότι οι τηλεφωνικές εταιρείες στις Ηνωμένες Πολιτείες πρέπει να ολοκληρώσουν την εφαρμογή του ελέγχου ταυτότητας καλούντος, όπως το Secure Telephone Identity Revisited (STIR) και το Signature-based Signature Handling of Asserted Information Using toKENs, συλλογικά γνωστά ως STIR/SHAKEN.

Είπε ότι ο κλάδος των τηλεπικοινωνιών θα πρέπει επίσης να «επισημαίνει ή να μπλοκάρει τους πλαστογραφημένους αριθμούς».

«Οι ομάδες κυβερνοασφάλειας μπορούν να καθοδηγήσουν το προσωπικό σε ασκήσεις ελέγχου ταυτότητας, να υιοθετήσουν ανίχνευση τεχνητής νοημοσύνης που επισημαίνει συνθετικές φωνές και να περιλαμβάνουν σαφείς προειδοποιήσεις όπως ‘Δεν θα ζητήσουμε ποτέ κωδικό μέσω τηλεφώνου’ σε κάθε σημείο επαφής με τον πελάτη», δήλωσε ο Χάους.

«Μαζί, αυτά τα μέτρα αυξάνουν το κόστος για τους απατεώνες και προσθέτουν εμπόδια στην κρίσιμη στιγμή της απόφασης.»

Του Κρις Σάμμερς