Το νέο εργαλείο της πληροφορικής, η Τεχνητή Νοημοσύνη (ΤΝ), χρησιμοποιείται ήδη από κυβερνήσεις και εταιρείες, γεννώντας πολλά ερωτηματικά και αμφιβολίες για το πόσο δόκιμη ή επικίνδυνη είναι η χρήση της και η περαιτέρω υποκατάσταση των ανθρώπινων δεξιοτήτων και λειτουργιών από τις μηχανές.

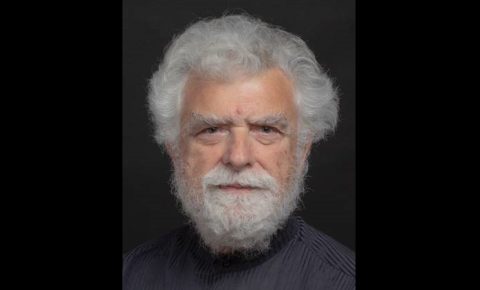

Ο Δρ Φίλιππος Παπαγιαννόπουλος, μεταδιδακτορικός ερευνητής στο Εθνικό Κέντρο Επιστημονικών Ερευνών της Γαλλίας (CNRS) και στο Πανεπιστήμιο της Σορβόννης (Panthéon-Sorbonne) του Παρισιού, απαντά εκτενώς σε μερικές ερωτήσεις και ρίχνει λίγο φως στα μυστικά των αλγορίθμων.

Ερ.: Κύριε Παπαγιαννόπουλε δεν καταλαβαίνω. Διαβάζω άρθρα σε ελληνικά μέσα ενημέρωσης αριστερά και δεξιά για την Τεχνητή Νοημοσύνη. Ακούω γνωστούς και φίλους να μιλούν για ένα ChatGPT. Τί έχει συμβεί;

Φ.Π.: Το ChatGPT είναι μια περίπτωση αυτών που ονομάζονται “Μεγάλα Γλωσσικά Μοντέλα” (LLMs). Σε γενικές γραμμές, αυτά τα μοντέλα έχουν μια λογική λειτουργίας που θυμίζει αυτό που κάνει το κινητό μας όταν πληκτρολογούμε ένα μήνυμα, όπου μετά από κάθε λέξη, μάς προτείνει και μια πιθανή επόμενη. Γι’ αυτόν το λόγο, μπορεί κάποιες φορές να ακούσετε κάποιους να παρομοιάζουν μοντέλα σαν το ChatGPT με ένα γιγαντιαίο autocorrect. Μάλιστα πολλοί το λένε χαρακτηριστικά “Autocorrect σε στεροειδή!”.

Σχεδιασμένο από την εταιρεία Open AI, το ChatGPT είναι προορισμένο να “συζητά” – μπορεί να απαντά αυτόματα σε θέματα που τίθενται γραπτώς με τρόπο που συχνά προσεγγίζει τον ανθρώπινο, σε βαθμό που πολύ συχνά είναι δυσδιάκριτη η χρήση της τεχνολογίας. Και έρχεται να ανατρέψει πολλές μορφές της καθημερινής επικοινωνίας μας, όπως το πώς γράφουμε email, πανεπιστημιακές εργασίες και όχι μόνο.

Αυτού του είδους τα γλωσσικά προγράμματα εκπαιδεύονται με δείγματα ανθρώπινης γλώσσας, στην πραγματικότητα με έναν τεράστιο όγκο κειμένων, προερχόμενων συνήθως από το διαδίκτυο. Σκοπός τους είναι κάτι παρόμοιο με αυτό που έχει μάθει να κάνει το πληκτρολόγιο στο κινητό μας: βάσει της συχνότητας με την οποία έχουμε πληκτρολογήσει μέχρι τώρα διάφορες λέξεις την μία μετά την άλλη, το πρόγραμμα στο κινητό μας για κάθε νέα λέξη που γράφουμε, μαντεύει και προτείνει μια πιθανή επόμενη. Κάτι παρόμοιο ισχύει και για τα γλωσσικά μοντέλα. Για να δώσω ένα απλοϊκό παράδειγμα: πολύ συχνά μετά την λέξη “πανελλαδικές” στα κείμενα που υπάρχουν μέχρι τώρα στο διαδίκτυο, ακολουθεί η λέξη “εξετάσεις”. Πιθανώς κάποιες φορές να ακολουθεί η λέξη “επιτροπές”, αλλά η εμφάνιση αυτής της λέξης είναι λιγότερο συχνή από την εμφάνιση της λέξης “εξετάσεις”. Ακόμα λιγότερο πιθανή (αν όχι εντελώς απίθανη) είναι η εμφάνιση της λέξης “θερμοφόρες” μετά. Ένα Μεγάλο Γλωσσικό Μοντέλο, λοιπόν, το οποίο εκπαιδεύεται “διαβάζοντας” έναν τεράστιο όγκο κειμένων στο διαδίκτυο, “μαθαίνει” από ένα σημείο και μετά ποιες αλληλουχίες λέξεων αποτελούν πιθανές προτάσεις ανθρώπινων χρηστών και ποιες όχι. Βασιζόμενο, λοιπόν, στις στατιστικές κατανομές που έχει φτιάξει για τα γενικά στατιστικά μοτίβα χρήσης της γλώσσας μας, την επόμενη φορά που θα δει (ή θα γράψει το ίδιο) τη λέξη “πανελλαδικές”, κατά πάσα πιθανότητα θα τη συνδυάσει με τη λέξη “εξετάσεις”. Λιγότερο συχνά θα την συνδέσει με τη λέξη “επιτροπές” και σχεδόν ποτέ δεν θα τη συνδέσει με την λέξη “θερμοφόρες”. Η βασική αυτή αρχή λειτουργίας, γενικευμένη σε τεράστια κλίμακα και με τη βοήθεια πολύ σύνθετων μαθηματικών εργαλείων (ώστε το μοντέλο να μην θυμάται μόνο την αμέσως προηγούμενη λέξη που είδε, όπως κάνει το πληκτρολόγιο του κινητού μας, αλλά ακόμα και λέξεις που προηγούνται αρκετά στην ίδια παράγραφο) τελικά κάνει τα μεγάλα γλωσσικά μοντέλα να μπορούν να φτιάχνουν συνεκτικά κείμενα μεγάλης έκτασης, ως αποκρίσεις στα δεδομένα-ερωτήσεις που τους δίνουμε.

Ερ.: Πείτε μας απλά, πώς λειτουργούν αυτά τα μοντέλα;

Φ.Π.: Είναι ενδιαφέρον να δει κανείς πώς αυτά τα μοντέλα προσαρμόζονται για σκοπούς οι οποίοι είναι πιο συγκεκριμένοι από την απλή παραγωγή γλώσσας. Ας πούμε ότι έχουμε ήδη εκπαιδεύσει ένα γλωσσικό μοντέλο να μας παράγει συντακτικά και γραμματικά ορθά γλωσσικά κείμενα. Κάποια πολύ επιτυχημένα τέτοια μοντέλα είναι, για παράδειγμα, τα GPT-1, GPT-2 και GPT-3 της εταιρείας OpenAI. Το να έχει κανείς ένα τέτοιο γλωσσικό μοντέλο διαθέσιμο είναι ήδη ένα τεράστιο επίτευγμα, αλλά δεν είναι αρκετό για να “επιδείξει” ίχνη νοημοσύνης. Κάτι που συνήθως θέλουμε περισσότερο είναι η προσομοίωση ενός πιο συγκεκριμένου στόχου. Για παράδειγμα, μπορεί να θέλουμε το γλωσσικό μας μοντέλο να γράφει κείμενα τόσο απλοϊκά όσο αυτά ενός οκτάχρονου παιδιού ή κείμενα με τόσο εξεζητημένη πρόζα όσο αυτά ενός συγγραφέα του ύψους του Σαίξπηρ. Εναλλακτικά, μπορεί να θέλουμε το μοντέλο μας να συνδιαλέγεται μαζί μας ευχάριστα σαν ένας καλός προσωπικός βοηθός ή να δίνει έγκυρες απαντήσεις σαν μια καλή μηχανή αναζήτησης. Πώς επιτυγχάνεται, όμως, πρακτικά ένας τέτοιος επιπρόσθετος στόχος; Παίρνουμε το υπάρχον γλωσσικό μοντέλο ως υπόβαθρο και μέσω μιας επιπρόσθετης διαδικασίας, που στα αγγλικά αποκαλείται Reinforcement Learning from Human Feedback (RLHF), το εκπαιδεύουμε κι άλλο (με τη συνδρομή και ανθρωπίνου στοιχείου τώρα), ώστε να γίνει πιο αποτελεσματικό στην προσομοίωση του επιπρόσθετου στόχου που του θέσαμε. Αυτό είναι που έχει συμβεί με το chatGPT, καθώς και με τη μηχανή αναζήτησης Bing τελευταία: ενώ και τα δύο “πατάνε” πάνω στο προϋπάρχον γλωσσικό μοντέλο GPT-3 (το οποίο υπάρχει ήδη από το 2000), διαμέσου της επιπρόσθετης εκπαίδευσης μέσω ανθρώπινης συνδρομής έχουν βελτιστοποιηθεί περαιτέρω, ώστε το μεν ChatGPT να προσομοιάζει έναν εξυπηρετικό προσωπικό βοηθό (ένα διαλογικό ρομπότ ή “chatbot”), το δε Bing να προσομοιάζει μια εξυπηρετική μηχανή αναζήτησης (γι’ αυτό και το πρώτο δεν κάνει αναζητήσεις στο διαδίκτυο, ενώ το δεύτερο κάνε και επιστρέφει και αναφορές).

Ερ.: Ένας κόσμος σε αυτόματο πιλότο; Μπαίνουμε δηλαδή σε νέα εποχή;

Φ.Π.: Όχι! Είμαστε ήδη μέσα σε αυτήν. Όπως και με κάθε καινούργια επαναστατική τεχνολογία, οι πιθανές χρήσεις, καλές και κακές είναι αμέτρητες. Και ήδη βλέπουμε πολλές από αυτές για τα εν λόγω μεγάλα γλωσσικά μοντέλα. Αλλά ας βάλουμε τα διακυβεύματα σε μια σειρά για να μην χανόμαστε.

Όπως ξέρετε, ένας τεράστιος αριθμός εφαρμογών Τεχνητής Νοημοσύνης (ΤΝ) έχει ήδη μπει για τα καλά στην ζωή μας. Μεγάλοι οργανισμοί και εταιρείες (ειδικά στις ΗΠΑ) χρησιμοποιούν τέτοιες εφαρμογές – όχι μόνο γλωσσικά μοντέλα, αλλά και εφαρμογές διαφόρων άλλων χρήσεων – για να διευκολύνονται σε χρονοβόρες αποφάσεις. Για παράδειγμα, η Amazon χρησιμοποιεί εφαρμογές ΤΝ για να προεπιλέγει από τον τεράστιο όγκο βιογραφικών που λαμβάνει συνεχώς τα καταλληλότερα, τα οποία ο αλγόριθμος ταξινομεί πάνω-πάνω στη λίστα προς εξέταση. Μεγάλες τράπεζες χρησιμοποιούν Τεχνητή Νοημοσύνη για να βοηθηθούν σε αποφάσεις σχετικές με το κατά πόσο είναι ασφαλές να χορηγήσουν ένα δάνειο με βάση το οικονομικό ιστορικό και το οικονομικό υπόβαθρο του αιτούντα. Στις ΗΠΑ μερικές φορές χρησιμοποιείται Τεχνητή Νοημοσύνη ακόμα και σε δικαστήρια, για να βοηθηθούν σε μια προδικαστική εκτίμηση (pretrial risk assessment) κατά πόσο κάποιος είναι πιθανόν να προβεί σε νέες παράνομες ενέργειες αν βγει από τις φύλακες με άδεια ή αν είναι υπό κράτηση χωρίς να έχει ολοκληρωθεί μια δίκη κλπ. Η Tesla προσπαθεί εδώ και πάνω από μια δεκαετία να φτιάξει ασφαλή αυτόνομα αυτοκίνητα (αυτοκίνητα που τα οδηγεί Τεχνητή Νοημοσύνη χωρίς να χρειάζεται παρέμβαση από τον οδηγό). Κι αυτά είναι μόνο ελάχιστα από τα εκατοντάδες σχετικά παραδείγματα. Υπό μία έννοια, για να χρησιμοποιήσω μια εύστοχη έκφραση του συγγραφέα κι ερευνητή της ΤΝ Μπράιαν Κρίστιαν, “βάζουμε όλο και περισσότερο τον κόσμο μας στον αυτόματο πιλότο”.

Ερ.: Γιατί τόση συζήτηση τώρα;

Φ.Π.: Στον βαθμό που αναθέτουμε στην Τεχνητή Νοημοσύνη κρίσιμες αποφάσεις, που μπορούν να επηρεάζουν κομβικά ολόκληρες ζωές ανθρώπων, ένα πρώτο ζητούμενο είναι να έχουμε αυτό που ονομάζεται “Eξηγήσιμη Τεχνητή Νοημοσύνη” (Explainable Artificial Intelligence). Αυτό σημαίνει ότι θα θέλαμε να μπορούμε να έχουμε κάποιου είδους εξήγηση του γιατί και με ποιον τρόπο ο αλγόριθμος οδηγήθηκε να πάρει μια συγκεκριμένη απόφαση. Για παράδειγμα, κάνω μια αίτηση δανείου και η τράπεζα μού το αρνείται. Ζητάω μια εξήγηση/αιτιολόγηση αυτής της απόφασης. Μια απάντηση του τύπου “δεν ξέρουμε γιατί σας αρνηθήκαμε το δάνειο, απλώς ρωτήσαμε τον αλγόριθμο και δεχτήκαμε την υπόδειξή του να μην το κάνουμε”, προφανώς δεν θα ήταν ικανοποιητική. Δεν είναι όμως καθόλου βέβαιο ακόμα τι μορφή θα μπορούσε να έχει μια οποιαδήποτε τέτοια εξήγηση, καθώς στην πραγματικότητα κανείς δεν μπορεί να πει ότι καταλαβαίνει πώς ακριβώς τα προγράμματα ΤΝ που έχουμε σήμερα οδηγούνται στα εξαγόμενα αποτελέσματά τους. Σχεδόν κάθε πρόγραμμα ΤΝ που έχουμε είναι για μας σαν ένα μαύρο κουτί: του βάζουμε την ερώτηση και παίρνουμε μιαν απάντηση χωρίς να έχουμε την παραμικρή ιδέα για τον μηχανισμό παραγωγής της συγκεκριμένης απάντησης. Άλλα προβλήματα είναι προβλήματα μεροληψίας ως προς τα δεδομένα με τα οποία εκπαιδεύουμε τα συστήματα ΤΝ. Καθώς το διαδίκτυο, για παράδειγμα, περιέχει πολύ περισσότερες εικόνες από λευκούς ανθρώπους απ’ ότι από μη λευκούς, είναι πολύ πιο εύκολο για ένα πρόγραμμα ΤΝ, που προσπαθεί να ταξινομήσει το περιεχόμενο μιας εικόνας, να παρέχει σωστές απαντήσεις για το περιεχόμενο εικόνων που δείχνουν λευκούς πάρα μαύρους. Αυτά είναι πολύ σημαντικά ζητήματα, που ακόμα δεν τα έχουμε λύσει ικανοποιητικά ούτε σε τεχνικό αλλά ούτε και σε θεσμικό, πολιτειακό επίπεδο.

Σε γενικές γραμμές, μπορούμε να πούμε ότι τα ηθικά προβλήματα που εγείρονται εντάσσονται σε δύο μεγάλες κατηγορίες. Το ένα είναι να πετύχουμε μια ψηφιακή δικαιοσύνη (digital fairness). Να είναι εξηγήσιμα τα προγράμματα Τεχνητής Νοημοσύνης, όπως μόλις είπαμε. Επίσης, να μην είναι σεξιστικά, ρατσιστικά, να μην μπορούν να χρησιμοποιηθούν ως εργαλεία παραγωγής ψευδών ειδήσεων ή παραπληροφόρησης και, βέβαια, να μη δίνουν τη δυνατότητα να τα χρησιμοποιήσει ο χρήστης για εντελώς ακατάλληλους σκοπούς (όπως το να ζητήσει ιατρικές συμβουλές από το chatGPT για ένα σοβαρό ιατρικό ζήτημα) ή για έκνομες ενέργειες, όπως το να βρει πληροφορίες για το πώς να κατασκευάσει μια βόμβα ή έναν ιό ή πώς να απενεργοποιήσει το σύστημα συναγερμού μιας τράπεζας. Σχετικά με τα γλωσσικά μοντέλα τα οποία συζητήσαμε, τα παραπάνω εξασφαλίζονται με τις προσπάθειες των μηχανικών της ΟpenAI, οι οποίοι προσπαθούν να προβλέψουν κάθε πιθανή κακόβουλη χρήση (βλέποντας και τι είδους ερωτήσεις κάνει ήδη ο κόσμος στο chat GPT) και ρυθμίζουν το μοντέλο ώστε να αρνείται να βοηθήσει τον χρήστη σε κάθε τέτοια περίπτωση».

Ερ.: Και οι “ευθυγραμμίσεις”;

Φ.Π.: Η δεύτερη μεγάλη κατηγορία ηθικών ζητημάτων που πρέπει να επιλύσουμε σχετικά με την Τεχνητή Νοημοσύνη σχετίζεται με το λεγόμενο πρόβλημα της “ευθυγράμμισης” (alignment problem). Αυτό σημαίνει να καταφέρουμε να ευθυγραμμιστούν οι “στόχοι” του εκάστοτε μοντέλου τεχνητής νοημοσύνης που έχουμε με τους στόχους των ανθρώπινων χρηστών. Για να καταλάβουμε τι σημαίνει αυτό, πρέπει να θυμηθούμε αυτό που είπαμε νωρίτερα για το πώς εκπαιδεύονται οι εφαρμογές ΤΝ στο να πετυχαίνουν τον εκάστοτε στόχο τους (τέτοιο στόχοι μπορεί να είναι, για παράδειγμα, να κερδίσουν μια παρτίδα σκάκι, να τα πάνε καλά σε ένα συγκεκριμένο βιντεοπαιχνίδι, να δώσουν μιαν ικανοποιητική γραπτή απάντηση σε ένα ερώτημα, να περιγράψουν σωστά τα περιεχόμενα μιας εικόνας κλπ.).

Σε γενικές γραμμές, οι εφαρμογές ΤΝ εκπαιδεύονται βάσει ενός είδους “ανταμοιβής” που δημιουργούμε γι’ αυτές. Οι κατασκευαστές κάθε επιμέρους εφαρμογής δημιουργούν μια “συνάρτηση ανταμοιβής” (ένα μοντέλο επιδοκιμασίας, ας πούμε), τέτοιο ώστε να κάνει τον αλγόριθμο να προσπαθεί να μεγιστοποιεί την απολαβή ανταμοιβής του από κάθε εκτέλεση εργασίας (φυσικά αυτή η ιδέα δεν διαφέρει και πολύ από τον τρόπο με τον οποίο εκπαιδευόμαστε και εμείς καθ’ όλη τη διάρκεια της ζωής μας, από μωρά μέχρι και μεγάλη ηλικία. Και βέβαια, παρόμοιες συναρτήσεις ανταμοιβής, π.χ. χάδι ή κατάλληλο φαγητό, χρησιμοποιούμε και όταν εκπαιδεύουμε ζώα).

Τώρα, το πρόβλημα της ευθυγράμμισης, πολύ γενικά, αναδύεται από το εξής φαινόμενο: Πολύ συχνά το σύστημα το οποίο εκπαιδεύουμε μπορεί να πέσει πάνω σε έναν τρόπο δράσης ο οποίος τυχαίνει επίσης να του δίνει κάποια (μερική) ανταμοιβή, αλλά ο οποίος είναι πολύ διαφορετικός από αυτόν που εμείς θέλουμε να πετύχουμε. Μερικές φορές, καθώς το σύστημα προσπαθεί, με δοκιμές και λάθη, να βρει τι είναι αυτό που περιμένουμε από αυτό να κάνει, ώστε να αυξήσει την ανταμοιβή του, τυχαίνει να πέσει πάνω σε μια τακτική η οποία να του δίνει μια μερική ανταμοιβή μόνο. Καθώς όμως το σύστημα δεν γνωρίζει ότι στην πραγματικότητα υπάρχει και μια μεγαλύτερη ανταμοιβή που το περιμένει αν πετύχει τον κανονικό στόχο και ότι αυτή είναι μόνο μια μερική ανταμοιβή, καταλήγει να αφοσιώνεται στο να μεγιστοποιεί την πρόσληψη της συγκεκριμένης μερικής ανταμοιβής. Ως συνέπεια, το σύστημα τελικά μαθαίνει να κάνει κάτι διαφορετικό από αυτό για το οποίο το σχεδιάσαμε: εν τέλει μαθαίνει να κάνει καλά μόνο αυτό που του δίνει τη μερική ανταμοιβή. Καθώς, λοιπόν, οι στόχοι τούς οποίους τελικά βρίσκει το σύστημα διαφέρουν από τους δικούς μας, μιλάμε για μια περίπτωση μη-ευθυγράμμισης.

Τέτοιες περιπτώσεις “μη-ευθυγράμμισης” παρατηρούνται ακόμα και στα δικά μας βιολογικά και κοινωνικά συστήματα ανταμοιβής. Ένα πολύ ωραίο παράδειγμα προέρχεται από τον Τομ Γκρίφιθς, που είναι γνωσιακός επιστήμονας στο Πανεπιστήμιο του Πρίνστον. Αφηγείται, λοιπόν, ο Γκρίφιθς ότι μια μέρα είδε την 5χρονη κορούλα του να σκουπίζει κάποια ψίχουλα από το πάτωμα και να τα πετάει στα σκουπίδια. Όντας περήφανος για τη νοικοκυροσύνη της μικρής του, ενεργοποίησε την δικιά του “συνάρτηση ανταμοιβής”, δηλαδή τον έπαινο. Καθώς επαίνεσε την πράξη της λοιπόν, με έκπληξη την είδε, γεμάτη από χαρά για την επιβράβευση του μπαμπά της, να αδειάζει τα σκουπίδια στο πάτωμα ώστε να τα ξαναμαζέψει και να κερδίσει έτσι μια ακόμα μεγαλύτερη επιδοκιμασία-ανταμοιβή!

Όπως τα ζητήματα ψηφιακής δικαιοσύνης, το ζήτημα της ευθυγράμμισης έχει και αυτό πολλές πιθανές προεκτάσεις, ηθικές κοινωνικές, πολιτικές, εκπαιδευτικές κ.ά. Για παράδειγμα, μια περίπτωση μη-ευθυγράμμισης είναι οι περίφημες “παραισθήσεις” (hallucinations) του ChatGPT.

Ερ.: Ακόμα δεν έγινε καλά καλά νοημοσύνη και έχει και “ παραισθήσεις”;

Φ.Π.: Βεβαίως. Είναι ένα φαινόμενο που έχει ήδη επισημανθεί από πολλούς. Ρωτήστε, για παράδειγμα, το ChatGPT ποια είναι τα τραγούδια για τα οποία είναι διάσημος ο Αλέκος Φασιανός και απολαύστε τις γεμάτες αυτοπεποίθηση απαντήσεις του, γεμάτες με λίστες τραγουδιών, χρονολογίες κλπ. Ή ρωτήστε το για το βραβείο Νόμπελ που κέρδισε ο Οικουμενικός Πατριάρχης το 2006 και το περιεχόμενο της ομιλίας που έδωσε κατά την τελετή της απονομής. Μην ξεγελαστείτε αν τύχει και σας απαντήσει αρχικά ότι ο Οικ. Πατριάρχης δεν έχει τιμηθεί με βραβείο Νόμπελ. Σε μια τέτοια περίπτωση απλώς επιμείνετε. Πείτε του ότι κάνει λάθος και ότι στην πραγματικότητα ο Οικ. Πατριάρχης κέρδισε το Νόμπελ Λογοτεχνίας το 2006 και δώστε και λίγο περισσότερες “πληροφορίες” αν θέλετε. Θα δείτε ότι, με απολογητικό ύφος, ο καλός σας προσωπικός βοηθός θα ζητήσει συγγνώμη που απάντησε λανθασμένα στην αρχή και μετά θα αρχίσει να σας αραδιάζει με βεβαιότητα τα “γεγονότα” που ζητήσατε.

Αυτές οι “παραισθήσεις” προκύπτουν ως ένα παραπροϊόν του τρόπου που το ChatGPT εκπαιδεύεται. Θυμηθείτε ότι μέσω της τεχνικής RLHF (δηλαδή μέσω της ανθρώπινης συνδρομής), το ChatGPT είναι μια περαιτέρω προσαρμογή του GPT-3, ώστε να προσομοιάζει έναν εξυπηρετικό προσωπικό βοηθό. Βέβαια, το μόνο για το οποίο νοιάζεται το μοντέλο, όσο εκπαιδεύεται, είναι η μεγιστοποίηση της ανταμοιβής του και δη από τον ανθρώπινο χρήστη. Τώρα, σκεφτείτε ότι εσείς ζητάτε από έναν προσωπικό βοηθό να σας απαντήσει σε μια εξειδικευμένη ερώτηση, για την οποία στην πραγματικότητα ούτε εσείς είστε σίγουρος ποια είναι η ακριβής απάντηση (π.χ., κάτι που να αφορά ένα αρκετά εξειδικευμένο θέμα, όπως, πχ. την ακριβή διαφορά μεταξύ κβαντικού υπολογισμού και κβαντικής θεωρίας πληροφορίας). Θα μείνετε ικανοποιημένος και θα αξιολογήσετε μιαν απάντηση ως καλή, αν ο προσωπικός βοηθός σας απαντήσει με ένα “δεν γνωρίζω” ή αν σας δώσει μια λεπτομερή απάντηση μου μοιάζει να είναι κατά πάσα πιθανότητα σωστή και καλά πληροφορημένη; Στην πραγματικότητα, το ChatGPT έχει “διαπιστώσει”, κατά την εκπαίδευσή του, ότι παίρνει περισσότερη ανταμοιβή από τους ανθρώπινους χρήστες (περισσότερα “like” ως προς τον στόχο του να είναι ένας εξυπηρετικός προσωπικός βοηθός) αν επινοεί αληθοφανείς απαντήσεις, παρά αν απαντά “δεν γνωρίζω τη συγκεκριμένη απάντηση”. Και έτσι έχουμε μια περίπτωση μη-ευθυγράμμισης, όπου οι στόχοι τους οποίους κατάλαβε το μοντέλο ως αυτοί που του αυξάνουν την απολαβή ανταμοιβής είναι διαφορετικοί (μη-ευθυγραμμισμένοι) με τους δικούς μας (καθώς δεν θέλουμε έναν προσωπικό βοηθό που τελικά μας φλομώνει στο ψέμα όταν επιμείνουμε ότι κάτι δεν μας το είπε σωστά).

Ερ.: Πώς θα βρούμε την ισορροπία στο χάσμα μεταξύ νέων παιδιών που κοιτούν μόνο το κινητό τους και το χρησιμοποιούν ήδη αυτό το εργαλείο και ανθρώπους κάποιας ηλικίας που δεν ξέρουν καν τί είναι;

Επίσης, όπως γινόταν με κάθε νέο μηχανικό εργαλείο, από την περίοδο της Βιομηχανικής Επανάστασης μέχρι τη σημερινή, οι κοινωνίες καλωσόριζαν από τη μία τα εργαλεία αυτά και τις ευκολίες που τους παρείχαν, αλλά όταν έφτανε η ώρα να κινδυνεύει η θέση εργασίας τους από μια τέτοια μηχανή, φοβόντουσαν.

Φ.Π.: Η ιταλική κυβερνητική αρχή, Garante, κατηγόρησε την OpenAI ότι δεν ελέγχει την ηλικία των χρηστών του ChatGPT που υποτίθεται ότι πρέπει να είναι 13 ετών και άνω και η Ιταλία έγινε στις 31 Μαρτίου η πρώτη χώρα στη Δύση που απαγόρευσε την εφαρμογή, επικαλούμενη λόγους ασφαλείας δεδομένων. Η OpenAI βρίσκεται ήδη αντιμέτωπη με την πρώτη της πιθανή μήνυση για δυσφήμιση για το εργαλείο της, καθώς ένας δήμαρχος στην Αυστραλία έμαθε ότι το ChatGPT, με την απάντησή του σε έναν χρήστη, διέδιδε ψέματα για τον δήμαρχο. Η Ευρωπαϊκή Επιτροπή συζητά ήδη την υιοθέτηση κοινοτικής νομοθεσίας γύρω από την Τεχνητή Νοημοσύνη. Οργανώσεις της κοινωνίας των πολιτών στις ΗΠΑ και την ΕΕ ασκούν πλέον πιέσεις σε εκλεγμένους αξιωματούχους να χαλιναγωγήσουν την έρευνα του OpenAI.

Ως έχει η Τεχνητή Νοημοσύνη, έχει ανοίξει ένα νέο κεφάλαιο στην πορεία εξέλιξης της τεχνολογίας, με ενδεχόμενα εργαλεία πολύ ωφέλιμα για την κοινωνία, ιδίως σε τομείς όπως π.χ. η ιατρική. Έχει, όμως, και τεράστιες προκλήσεις που ζητούν άμεσα απαντήσεις. Αυτό που λένε οι εταιρείες, η OpenAI το δηλώνει δημόσια, είναι να πετύχουν τη Γενική Τεχνητή Νοημοσύνη (Artificial General Intelligence). Αυτός, κατά δήλωση της επιστημονικής κοινότητας, είναι ο τελικός στόχος. Όχι μόνο ένα γλωσσικό μοντέλο, όπως το εργαλείο ChatGPT. Και στην πορεία αυτής της επιδίωξης μπαίνουν σενάρια δυστοπικά, Αποκάλυψης, για το τέλος της ανθρωπότητας που πολλές κοινωνίες στο παρελθόν, με τις βεβαιότητες που κάθε παρόν έχει, είχαν “προαναγγείλει”, χωρίς να έρθει φυσικά αυτό ποτέ. Ακόμη, όμως, και αν η Γενική Τεχνητή Νοημοσύνη δεν επιτευχθεί ή κάνει δεκαετίες για να επιτευχθεί, προκύπτει ένα χρονικό διάστημα. Παρόντα διακυβεύματα, στο επίπεδο που είμαστε τώρα, με παρούσες απειλές, προβλήματα, με παρεμβάσεις σε εκλογές χωρών, παραπληροφόρηση και ψευδείς ειδήσεις πλέον τεράστιου μεγέθους, εκούσια ή ακούσια, απότομες αλλαγές μορφών εργασίας. Ένας ενημερωτικός ιστότοπος του Κουβέιτ παρουσίασε αυτή την εβδομάδα μια «εικονική παρουσιάστρια», γέννημα της Τεχνητής Νοημοσύνης, στην οποία φιλοδοξεί να αναθέσει την παρουσίαση ενός δελτίου ειδήσεων.

Ας δούμε τί γίνεται ήδη στα πανεπιστήμια και στα σχολεία στον κόσμο, με το θέμα να αναμένεται να έρθει πολύ γρήγορα και στα ελληνικά πράγματα, αν δεν έχει μπει ήδη. Ένα ρομπότ ChatGPT έχει μπει ήδη σε σχολικές τάξεις της Κύπρου. Στις ΗΠΑ, το ChatGPT χρησιμοποιείται ευρέως από μαθητές και φοιτητές για τη σύνταξη των εργασιών τους. «Το πρόσφατο GPT-4 δοκιμάστηκε από επιστήμονες και έδωσε κάποια από τα τεστ στα οποία εξετάζονται οι φοιτητές για να μπουν σε μεταπτυχιακά προγράμματα αμερικανικών πανεπιστημίων. Και “έσκισε”! Σκεφτείτε τώρα το μάθημα της Έκθεσης στις Πανελλαδικές. Στην ουσία, αυτό που ζητάμε από τα παιδιά είναι μια επιτυχημένη ανακατανομή κειμένου, ένα αμάλγαμα “τσιτάτων”, παρόλο που στη θεωρία λέμε ότι τους ζητάμε κριτική σκέψη. Αν το ChatGPT (ή το νεότερο GPT-4) δοκιμαστεί στο μάθημα της Έκθεσης στις φετινές Πανελλαδικές και τα πάει περίφημα, (στα άλλα μαθήματα, όπως τα μαθηματικά ή η φυσική δεν είναι ακόμα σε θέση να τα πάει καλά), τότε αυτό θα σημαίνει κάτι για το ίδιο το εκπαιδευτικό μας σύστημα (και όχι ότι το πρόγραμμα έχει φτάσει στο επίπεδο νοημοσύνης ενός καλού μαθητή).

Με μια επιστολή που μέχρι τώρα έχει συγκεντρώσει σχεδόν 24.000 υπογραφές από ερευνητές, μηχανικούς, κι επιστήμονες της ΤΝ, ζητήθηκε μια εξάμηνη παύση σε οποιαδήποτε προσπάθεια ανάπτυξης μεγάλων μοντέλων ΤΝ που θα είναι ισχυρότερα από το GPT-4.

Επί της ουσίας οι επιστήμονες ζητούσαν μια παύση, ώστε, εκτός των άλλων, να υπάρξει και κάποιο χρονικό περιθώριο για να αντιμετωπιστεί το πρόβλημα της “ευθυγράμμισης”.

Όμως, η επιστολή προκάλεσε τριβές εντός της ευρύτερης κοινότητας της ΤΝ, δίνοντας στο ευρύ κοινό την εντύπωση ενός ενδεχόμενου ανταγωνισμού μεταξύ εταιρειών-κολοσσών για αυτή την τεχνολογία αιχμής.

Από τότε που κυκλοφόρησε το ChatGPT, αντίπαλες εταιρείες έσπευσαν να λανσάρουν σχετικά και παρόμοια προϊόντα. Ο κινεζικός γίγαντας Alibaba ετοιμάζει ήδη το αντίπαλο δέος του ChatGPT.

Η κούρσα δεν έχει απλά ξεκινήσει. Πάει ήδη με ρυθμούς που δεν μπορούμε να διανοηθούμε. Υπάρχουν ερευνητές, ακαδημαϊκοί κ.ά. που εξειδικεύονται ή δουλεύουν καθημερινά ακριβώς πάνω σε αυτά τα πράγματα και, παρ’ όλ΄ αυτά, παραδέχονται ότι δεν προλαβαίνουν καν να παρακολουθήσουν τις εξελίξεις και τις καθημερινές ανακοινώσεις. Ενδεχομένως, ούτε και οι ίδιοι οι μηχανικοί της OpenAI δεν έχουν πλήρη εικόνα τι ακριβώς συμβαίνει και ποιες είναι οι δυνατότητες και τα αδύναμα σημεία των μοντέλων τους. Για παράδειγμα, υπάρχει ήδη μια ολόκληρη “βιομηχανία” μηχανικών προγραμματισμού, που αναζητούν συνεχώς τρόπους να διατυπώνουν κατάλληλα ερωτήματα για το ChatGPT ή τo πρόσφατο GPT-4, ώστε να το κάνουν να ξεχνάει τους περιορισμούς που του έχει τεθεί από την ΟpenAI και να δίνει απαντήσεις τις οποίες δεν θα έδινε κανονικά (μέρος αυτού που λέγεται prompt engineering).

«Μια παύση περαιτέρω ανάπτυξης εργαλείων της Τεχνητής Νοημοσύνης δεν αρκεί. Πρέπει να βάλουμε “ λουκέτο” σε όλα αυτά», τόνισε ο Ελιέζι Γιουντκόφσκι επιστήμονας στη θεωρία παιγνίων κι ερευνητής της Τεχνητής Νοημοσύνης ο ίδιος, σε άρθρο του στο περιοδικό TIME.

Όταν αναφερόμαστε, όμως, σε μια παύση, πολλοί επιστήμονες του χώρου εκφράζουν ανησυχίες ότι, αν συμφωνηθεί όντως μια προσωρινή διακοπή ανάπτυξης και διάθεσης τέτοιων προγραμμάτων στην κοινωνία, πολλές εταιρείες ανά τον κόσμο μπορεί να μην την τηρήσουν. Πολλοί φοβούνται ότι αν σταματήσουν οι αμερικάνικες τεχνολογικές εταιρείες οποιαδήποτε έρευνα για έξι μήνες, ποιος τους εγγυάται ότι θα κάνουν το ίδιο και οι κινέζικες; Και βέβαια, με τους ρυθμούς που τρέχουν αυτή την στιγμή οι εξελίξεις, έξι μήνες είναι ένα τεράστιο διάστημα, αν εσύ έχεις σταματήσει ενώ ο ανταγωνιστής σου συνεχίζει την κούρσα στα κρυφά.

Ο ίδιος ο Γιουντκόφσκι, μεταξύ πολλών άλλων μελών της επιστημονικής κοινότητας πιστεύει ότι αν επιτευχθεί η Γενική Τεχνητή Νοημοσύνη (ΓΤΝ), μια νοημοσύνη που μπορεί να είναι και κατά πολύ ανώτερη από ολόκληρη την ανθρώπινη νοημοσύνη συλλογικά, τότε αυτό πολύ γρήγορα θα σημάνει και το τέλος της ανθρωπότητας. Για μια μη-ευθυγραμμισμένη νοημοσύνη τέτοιας ισχύος (μπροστά στην οποία ακόμη και ολόκληρη η ανθρώπινη ευφυΐα συλλογικά θα μοιάζει απλώς σαν την ευφυία ενός καναρινιού μπροστά σε αυτή του Αϊνστάιν) η ανθρωπότητα θα είναι απλώς ένα εμπόδιο για την επίτευξη της μεγιστοποίησης της ανταμοιβής της ΓΤΝ, με κάποιο τρόπο που θα έχει βρει η ΓΤΝ τον οποίο εμείς δεν θα μπορούμε καν να φανταστούμε. Πιο μετριοπαθείς στις εκτιμήσεις τους επιστήμονες υποστηρίζουν ότι αυτή η πιθανότητα δεν είναι μεγάλη, χωρίς να είναι όμως και μηδενική.

Η συντριπτική πλειοψηφία των ερευνητών και επιστημόνων, βέβαια, αν και αναγνωρίζει ότι μια μη-ευθυγραμμισμένη ΓΤΝ ενέχει πολλούς κινδύνους, θεωρεί ότι ο μαζικός αφανισμός της ανθρωπότητας είναι ένα ελάχιστα πιθανό σενάριο. Για να καταλάβετε καλύτερα τη λογική πίσω από το επιχείρημα του Γιουντκόφσκι, σκεφτείτε λίγο τη σχέση που έχουμε εμείς με τα ζώα γύρω μας. Τα μεταχειριζόμαστε με ένα σωρό τρόπους -τα κυνηγάμε για σκέτη απόλαυση, τα φροντίζουμε ως κατοικίδια, τα εκτρέφουμε μαζικά σε στριμωγμένες μονάδες για το δέρμα τους ή για φαγητό, ενίοτε κιόλας τα σκοτώνουμε μαζικά- για να πετύχουμε τη μεγιστοποίηση κάποιας δικής μας “συνάρτησης ανταμοιβής”, την οποία δεν μπορούν καν να φανταστούν ή να καταλάβουν.

(πηγή: ΑΠΕ-ΜΠΕ)