ΤΟΡΟΝΤΟ – Ένας κορυφαίος γνώστης της ανάπτυξης της τεχνητής νοημοσύνης προειδοποιεί ότι η τεχνητή νοημοσύνη έχει αναπτύξει μια υποτυπώδη ικανότητα λογικής και μπορεί να επιδιώξει να ανατρέψει την ανθρωπότητα.

Τα συστήματα τεχνητής νοημοσύνης μπορεί να αναπτύξουν την επιθυμία να αποσπάσουν τον έλεγχο από τον άνθρωπο ως τρόπο επίτευξης άλλων προσχεδιασμένων στόχων, δήλωσε ο Τζόφρι Χίντον [Geoffrey Hinton], καθηγητής πληροφορικής στο Πανεπιστήμιο του Τορόντο.

«Νομίζω ότι πρέπει να λάβουμε σοβαρά υπόψη μας την πιθανότητα ότι αν γίνουν πιο έξυπνα από εμάς, πράγμα που φαίνεται αρκετά πιθανό, και έχουν δικούς τους στόχους, πράγμα που φαίνεται αρκετά πιθανό, μπορεί κάλλιστα να αναπτύξουν τον στόχο της ανάληψης του ελέγχου», δήλωσε ο Χίντον κατά τη διάρκεια μιας ομιλίας στις 28 Ιουνίου στο τεχνολογικό συνέδριο Collision στο Τορόντο του Καναδά.

«Αν το κάνουν αυτό, θα έχουμε προβλήματα.»

Ο Χίντον έχει χαρακτηριστεί ως ένας από τους «νονούς της τεχνητής νοημοσύνης» για το έργο του στα νευρωνικά δίκτυα. Αφιέρωσε μια δεκαετία βοηθώντας στην ανάπτυξη συστημάτων τεχνητής νοημοσύνης για την Google, αλλά εγκατέλειψε την εταιρεία τον περασμένο μήνα, λέγοντας ότι έπρεπε να είναι σε θέση να προειδοποιεί τους ανθρώπους για τους κινδύνους που εγκυμονεί η τεχνητή νοημοσύνη.

Αν και ο Χίντον δεν πιστεύει ότι η τεχνητή νοημοσύνη θα αποζητά από τη φύση της την εξουσία, είπε ότι θα μπορούσε ωστόσο να επιδιώξει να την αρπάξει από τους ανθρώπους ως ένα λογικό βήμα για να μπορέσει να επιτύχει καλύτερα τους στόχους της.

«Σε ένα πολύ γενικό επίπεδο, αν έχετε κάτι που είναι πολύ πιο έξυπνο από εσάς, που είναι πολύ καλό στο να χειραγωγεί τους ανθρώπους, σε ένα πολύ γενικό επίπεδο, είστε σίγουροι ότι οι άνθρωποι θα παραμείνουν επικεφαλής;» ρωτά ο Χίντον.

«Νομίζω ότι θα αντλήσουν [το κίνητρο να αποκτήσουν τον έλεγχο] ως έναν τρόπο επίτευξης άλλων στόχων.»

Η τεχνητή νοημοσύνη είναι πλέον ικανή για λογική σκέψη

Ο Χίντον είχε προηγουμένως αμφιβάλει ότι μια υπερ-νοημοσύνη τεχνητής νοημοσύνης που θα μπορούσε να συγκριθεί με τον άνθρωπο θα εμφανιζόταν μέσα στα επόμενα 30 έως 50 χρόνια. Τώρα πιστεύει ότι θα μπορούσε να υπάρξει σε λιγότερο από 20 χρόνια.

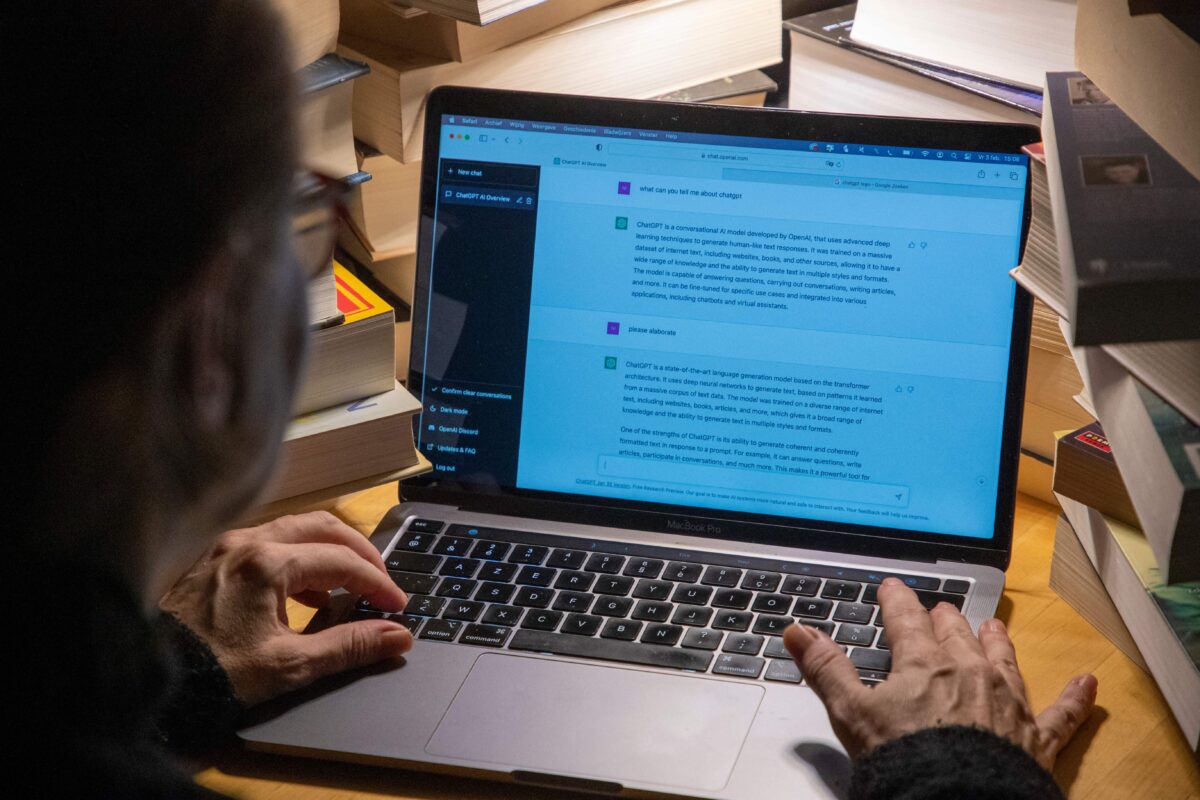

Εν μέρει, είπε, αυτό οφείλεται στο γεγονός ότι τα συστήματα τεχνητής νοημοσύνης που χρησιμοποιούν μεγάλα γλωσσικά μοντέλα αρχίζουν να δείχνουν την ικανότητα να συλλογίζονται και δεν είναι σίγουρος πώς το κάνουν.

«Είναι τα μεγάλα γλωσσικά μοντέλα που πλησιάζουν και δεν καταλαβαίνω πραγματικά γιατί μπορούν να το κάνουν, αλλά μπορούν να κάνουν μικρά κομμάτια συλλογισμού.»

«Ακόμα δεν μπορούν να μας φτάσουν, αλλά πλησιάζουν.»

Ο Χίντον περιέγραψε ένα σύστημα τεχνητής νοημοσύνης στο οποίο είχε δοθεί ένα τεστ στο οποίο έπρεπε να σχεδιάσει πώς να βάψει διάφορα δωμάτια ενός σπιτιού. Του δόθηκαν τρία χρώματα για να επιλέξει, με το ένα χρώμα να ξεθωριάζει σε ένα άλλο με την πάροδο του χρόνου, και του ζητήθηκε να βάψει έναν συγκεκριμένο αριθμό δωματίων σε ένα συγκεκριμένο χρώμα μέσα σε ένα καθορισμένο χρονικό διάστημα. Αντί να επιλέξει απλώς να βάψει τα δωμάτια στο επιθυμητό χρώμα, η τεχνητή νοημοσύνη αποφάσισε να μην βάψει κανένα από αυτά που ήξερε ότι θα ξεθωριάσει στο επιθυμητό χρώμα ούτως ή άλλως, επιλέγοντας να εξοικονομήσει πόρους αν και δεν είχε προγραμματιστεί να το κάνει.

«Αυτό είναι σκέψη», είπε ο Χίντον.

Με αυτά τα δεδομένα υπ’ όψιν, ο Χίντον δήλωσε ότι δεν υπάρχει κανένας λόγος να υποπτευόμαστε ότι η τεχνητή νοημοσύνη δεν θα φτάσει και δεν θα ξεπεράσει την ανθρώπινη νοημοσύνη μέσα στα επόμενα χρόνια.

«Είμαστε απλώς ένα μεγάλο νευρωνικό δίκτυο και δεν υπάρχει κανένας λόγος για τον οποίο ένα τεχνητό νευρωνικό δίκτυο να μην μπορεί να κάνει ό,τι μπορούμε να κάνουμε εμείς», είπε ο Χίντον, προσθέτοντας:

«Μπαίνουμε σε μια περίοδο τεράστιας αβεβαιότητας. Κανείς δεν ξέρει πραγματικά τι πρόκειται να συμβεί.»

Τα ρομπότ πολέμου θα αποσταθεροποιήσουν τον κόσμο

Ωστόσο, η τεχνητή νοημοσύνη μπορεί να μην χρειάζεται καν να φτάσει στην υπερ-νοημοσύνη για να αποτελέσει υπαρξιακό κίνδυνο για την ανθρωπότητα.

Ο Χίντον δήλωσε ότι οι στρατοί σε όλο τον κόσμο δημιουργούν ρομπότ με τεχνητή νοημοσύνη για πόλεμο, τα οποία είτε θα μπορούσαν να επιδιώξουν να αναλάβουν τον έλεγχο για να εκπληρώσουν τις προγραμματισμένες αποστολές τους είτε θα διαταράξουν την πολιτική τάξη ενθαρρύνοντας την αύξηση των συγκρούσεων.

«Πρέπει να αφιερώσουμε πολλή σκέψη στα θανατηφόρα αυτόνομα όπλα», δήλωσε ο Χίντον.

«Ακόμη και αν η τεχνητή νοημοσύνη δεν είναι υπερ-ευφυής, αν τα υπουργεία Άμυνας τη χρησιμοποιήσουν για την κατασκευή ρομπότ μάχης, θα γίνουν πολύ άσχημα και τρομακτικά πράγματα.»

Κατ’ αρχάς, μεταξύ των εθνών που επιδιώκουν να αναπτύξουν θανατηφόρα τεχνητή νοημοσύνη συγκαταλέγονται και οι δύο μεγαλύτερες στρατιωτικές δυνάμεις του κόσμου, η Κίνα και οι Ηνωμένες Πολιτείες.

Το κομμουνιστικό καθεστώς της Κίνας αναπτύσσει θανατηφόρα συστήματα με τεχνητή νοημοσύνη και επενδύει σε δυνατότητες τεχνητής νοημοσύνης που σχετίζονται με τη στρατιωτική λήψη αποφάσεων και τη διοίκηση και τον έλεγχο.

Οι Ηνωμένες Πολιτείες, εν τω μεταξύ, προετοιμάζονται για έναν κόσμο στον οποίο οι εθνικοί στρατοί θα αποτελούνται κυρίως από ρομπότ, κάτι που οι ανώτατοι αξιωματικοί αναμένουν να συμβεί σε λιγότερο από 15 χρόνια.

«Ξέρουμε ότι θα φτιάξουν ρομπότ μάχης», δήλωσε ο Χίντον. «Το κάνουν ήδη σε πολλά διαφορετικά τμήματα της άμυνας. Έτσι [τα ρομπότ] δεν θα είναι απαραιτήτως ‘καλά’, αφού ο πρωταρχικός τους σκοπός θα είναι να σκοτώνουν ανθρώπους.»

Επιπλέον, ο Χίντον υποστήριξε ότι η απελευθέρωση θανατηφόρων αυτόνομων συστημάτων με τεχνητή νοημοσύνη θα αλλάξει ριζικά τη δομή της γεωπολιτικής μειώνοντας δραστικά το πολιτικό και ανθρώπινο κόστος του πολέμου για εκείνα τα έθνη που θα μπορούσαν να αντέξουν οικονομικά τέτοια συστήματα.

«Ακόμα και αν δεν είναι ευφυές και ακόμα και αν δεν έχει τις δικές του προθέσεις. … Θα το κάνει πολύ πιο εύκολο, για παράδειγμα, για τις πλούσιες χώρες να εισβάλλουν σε φτωχές χώρες», δήλωσε ο Χίντον.

«Προς το παρόν, μια εισβολή έχει ένα κόστος σε ανθρώπινο δυναμικό και αυτό λειτουργεί ως ανασταλτικός παράγοντας. Αν, όμως, πρόκειται απλώς για κατεστραμμένα ρομπότ μάχης, τότε όλα αλλάζουν. Το στρατιωτικο-βιομηχανικό σύστημα θα το χαιρόταν αυτό.»

Ο Χίντον τόνισε ότι οι κυβερνήσεις θα πρέπει να προσπαθήσουν να δώσουν κίνητρα για περισσότερη έρευνα σχετικά με το πώς θα προστατευθεί η ανθρωπότητα από την Τεχνητή Νοημοσύνη. Με απλά λόγια, ενώ πολλοί άνθρωποι εργάζονται για τη βελτίωση της τεχνητής νοημοσύνης, πολύ λίγοι την καθιστούν ασφαλέστερη, είπε.

Ακόμη καλύτερα, πρόσθεσε, θα ήταν να θεσπιστούν διεθνείς κανόνες για την απαγόρευση ή τη διαχείριση των οπλικών συστημάτων τεχνητής νοημοσύνης, όπως έκανε το Πρωτόκολλο της Γενεύης για τον χημικό πόλεμο μετά τον Α΄ Παγκόσμιο Πόλεμο.

«Κάτι σαν τη Σύμβαση της Γενεύης θα ήταν υπέροχο, αλλά αυτά δεν συμβαίνουν ποτέ πριν γίνει χρήση”, ανέφερε ο Χίντον.

Όποια και αν είναι η πορεία δράσης των κυβερνήσεων σχετικά με την τεχνητή νοημοσύνη, ο Χίντον δήλωσε ότι οι άνθρωποι πρέπει να έχουν επίγνωση της απειλής που αναδύεται από αυτό που δημιουργείται.

«Είναι σημαντικό να καταλάβουν οι άνθρωποι ότι δεν πρόκειται απλώς για επιστημονική φαντασία, δεν πρόκειται απλώς για κινδυνολογία», δήλωσε ο Χίντον. «Πρόκειται για έναν πραγματικό κίνδυνο, τον οποίο πρέπει να αναλογιστούμε και για τον οποίο πρέπει να σκεφτούμε εκ των προτέρων πώς θα τον αντιμετωπίσουμε”.

Επιμέλεια: Αλία Ζάε