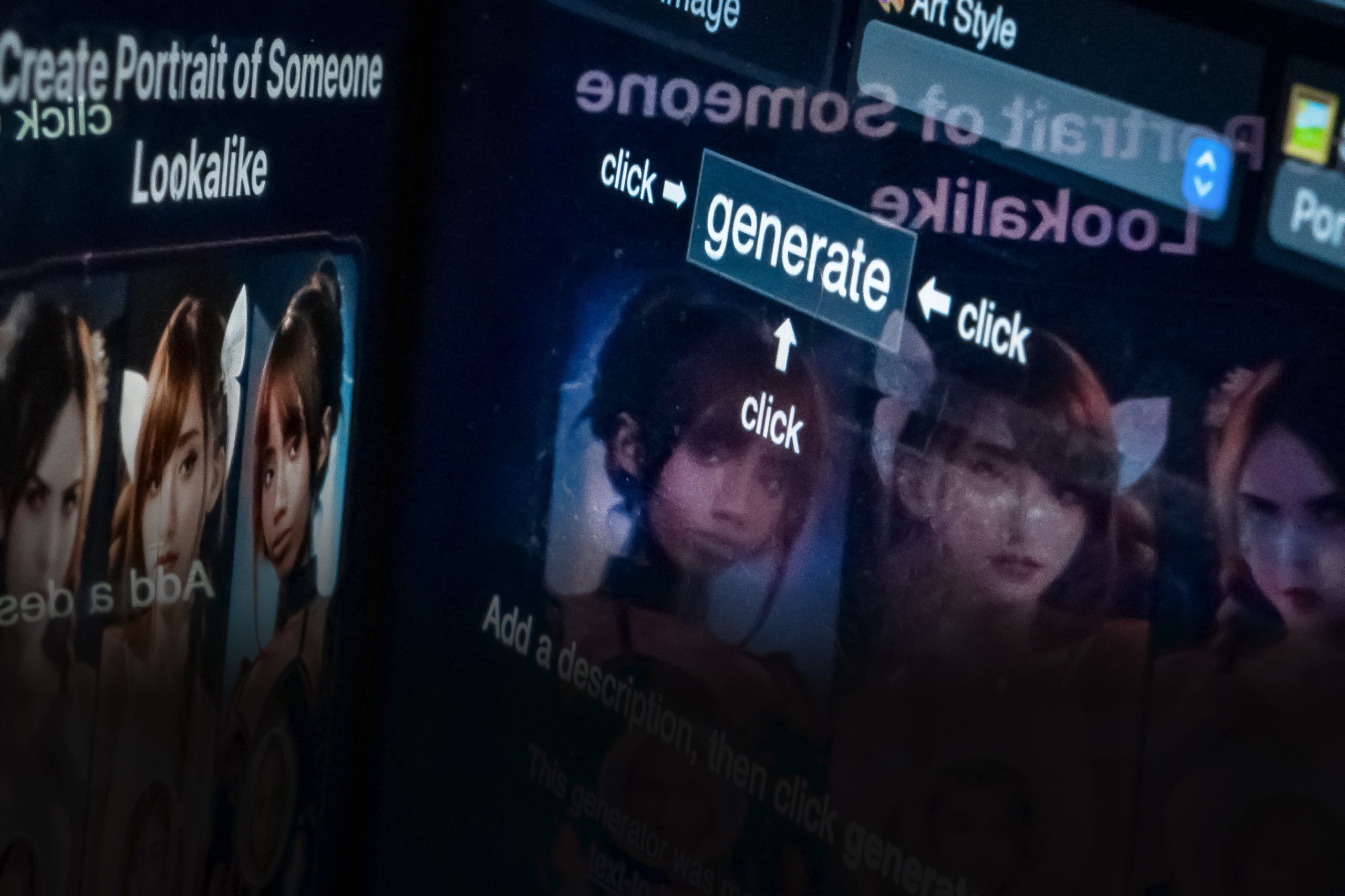

Έχει περάσει ο καιρός που τη μεγαλύτερη ανησυχία προκαλούσαν οι καρικατούρες των καθηγητών και οι εικόνες που έδειχναν μαθητές με σώματα αστείων ζώων.

Αυτά ήταν πριν από 30 και κάτι χρόνια. Τώρα, τα σχολεία αναγκάζονται να αναπτύξουν μεθόδους αντιμετώπισης έκτακτης ανάγκης σε περίπτωση που εμφανιστούν στα μέσα κοινωνικής δικτύωσης εικόνες σεξουαλικού περιεχομένου μαθητών ή εκπαιδευτικών που έχουν παραχθεί με τη χρήση τεχνητής νοημοσύνης (ΤΝ).

Σε δύο διαφορετικές περιπτώσεις, διευθυντές σχολείων εθεάθησαν ή ακούστηκαν να εκφράζονται με ρατσιστικό και βίαιο τρόπο κατά μαύρων μαθητών. Και στις δύο περιπτώσεις, επρόκειτο για ψεύτικα βίντεο που δημιουργήθηκαν με τεχνητή νοημοσύνη – το ένα δημιουργήθηκε από μαθητές και το άλλο από έναν δυσαρεστημένο γυμναστή, ο οποίος αργότερα συνελήφθη.

Ως deepfake ορίζονται οι «μη συναινετικά παραγόμενες από τεχνητή νοημοσύνη φωνές, εικόνες ή βίντεο που δημιουργούνται για την παραγωγή σεξουαλικών εικόνων, τη διάπραξη απάτης ή τη διάδοση παραπληροφόρησης», σύμφωνα με μια μη κερδοσκοπική ομάδα που επικεντρώνεται στη ρύθμιση της τεχνητής νοημοσύνης.

Καθώς οι διευθυντές των σχολείων προσπαθούν να καθορίσουν μία πολιτική για να μετριάσουν τη ζημιά που προκαλούν τα deepfake – και ενώ οι πολιτειακοί νομοθέτες εργάζονται για την ποινικοποίηση τέτοιων κακόβουλων πράξεων που αφορούν ειδικά τα σχολεία ή τα παιδιά – η τεχνολογία για την καταπολέμηση των εργαλείων τεχνητής νοημοσύνης που μπορούν να αντιγράψουν την εικόνα και τη φωνή ενός ατόμου δεν υπάρχει ακόμη, λέει ο Άντριου Μπούχερ, ιδρυτής και διευθύνων σύμβουλος του μη κερδοσκοπικού ερευνητικού οργανισμού Opportunity Labs.

«Χρειάζεται πολλή δουλειά, τόσο στον τομέα της πρόληψης όσο και στον τομέα της αντιμετώπισης των περιστατικών», δήλωσε κατά τη διάρκεια μιας διαδικτυακής συζήτησης που διοργάνωσε το Education Week τον περασμένο μήνα σχετικά με τη διδασκαλία του ψηφιακού γραμματισμού και του γραμματισμού στα μέσα ενημέρωσης στην εποχή της τεχνητής νοημοσύνης. «Αφορά την κοινωνική συμπεριφορά, [επειδή] ο τεχνικός μετριασμός είναι ακόμα αρκετά μακριά.»

Νομοθεσία κατά των deepfake

Στις 29 Σεπτεμβρίου, ο κυβερνήτης της Καλιφόρνια Γκάβιν Νιούσομ υπέγραψε σε νόμο ένα νομοσχέδιο που ποινικοποιεί την παιδική πορνογραφία που παράγεται με τεχνητή νοημοσύνη. Είναι πλέον κακούργημα στη Χρυσή Πολιτεία η κατοχή, η δημοσίευση και η μεταβίβαση εικόνων ατόμων κάτω των 18 ετών που προσομοιώνουν σεξουαλική συμπεριφορά.

Παρόμοιοι νέοι νόμοι υπάρχουν στη Νέα Υόρκη, στο Ιλινόις και στην πολιτεία της Ουάσιγκτον.

Σε εθνικό επίπεδο, ο γερουσιαστής Τεντ Κρουζ (R-Texas) πρότεινε το νομοσχέδιο Take It Down Act, το οποίο ποινικοποιεί τη «σκόπιμη αποκάλυψη μη συναινετικών οπτικών απεικονίσεων ατόμων σε ιδιωτικές στιγμές».

Το ομοσπονδιακό νομοσχέδιο ορίζει το deepfake ως «βίντεο ή εικόνα που παράγεται ή τροποποιείται ουσιαστικά με τη χρήση τεχνικών μηχανικής μάθησης ή οποιουδήποτε άλλου μέσου που παράγεται από υπολογιστή ή μηχανή για να απεικονίσει ψευδώς την εμφάνιση ή τη συμπεριφορά ατόμου σε οπτική απεικόνιση ιδιωτικής στιγμής».

Οι σχολικές περιφέρειες, εν τω μεταξύ, αναζητούν καθοδήγηση για το αναδυόμενο πρόβλημα που απειλεί όχι μόνο τους μαθητές, αλλά και το προσωπικό.

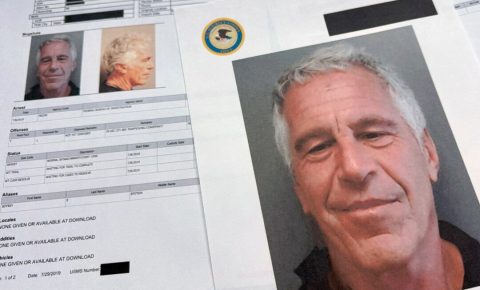

Τον Ιανουάριο, στο Λύκειο Pikesville του Μέρυλαντ, κυκλοφόρησε μια ψεύτικη ηχογράφηση του διευθυντή. Οι υπεύθυνοι του σχολείου ζήτησαν τη βοήθεια των τοπικών αστυνομικών υπηρεσιών και του FBI.

Ο ύποπτος, ο γυμναστής Ντάτζον Ντάριεν, 31 ετών, κατηγορήθηκε για κλοπή, παρενόχληση, διατάραξη της λειτουργίας του σχολείου και αντίποινα κατά μάρτυρα.

Φέρεται να έκανε την ηχογράφηση για να εκδικηθεί τον διευθυντή, ο οποίος ερευνούσε κατηγορία εις βάρος του Ντάριεν για κακή διαχείριση των σχολικών κονδυλίων, σύμφωνα με δελτίο ειδήσεων της 25ης Απριλίου στην ιστοσελίδα της κυβέρνησης της κομητείας Βαλτιμόρης.

Ο Τζιμ Σηγκλ, ανώτερος τεχνολόγος του Future of Privacy Forum, δήλωσε κατά τη διάρκεια της συζήτησης στο πάνελ της Εβδομάδας Εκπαίδευσης ότι οι ερευνητές στην υπόθεση της Βαλτιμόρης συσχέτισαν τον ύποπτο με το έγκλημα εξετάζοντας «τα αρχεία καταγραφής πρόσβασης σε υπολογιστές παλαιάς κοπής».

Όμως, καθώς η τεχνολογία της τεχνητής νοημοσύνης συνεχίζει να εξελίσσεται, ίσως χρειαστεί να αναπτυχθεί ένα σύστημα υδατογράφησης για τον παραγόμενο ήχο ή το βίντεο που θα αντικαταστήσει τα απαρχαιωμένα συστήματα παρακολούθησης και διασφάλισης της χρήσης των σχολικών υπολογιστών, δήλωσε ο κος Σηγκλ.

Τον Φεβρουάριο του 2023, μαθητές Λυκείου στο Καρμέλ της Νέας Υόρκης χρησιμοποίησαν τεχνητή νοημοσύνη για να αναπαραστήσουν έναν διευθυντή Γυμνασίου, και δημοσίευσαν το αποτέλεσμα στο TikTok. Οι ερευνητές κατάφεραν να συνδέσουν τις δραστηριότητες των μαθητών με τους λογαριασμούς τους. Τους επιβλήθηκαν πειθαρχικές κυρώσεις βάσει των κατευθυντήριων γραμμών του σχολικού κώδικα συμπεριφοράς, αλλά δεν τους απαγγέλθηκαν ποινικές κατηγορίες, σύμφωνα με δήλωση που δημοσιεύθηκε στη σελίδα της περιφέρειας στο Facebook .

«Ως οργανισμός που έχει δεσμευτεί για την πολυμορφία και την ένταξη», αναφέρεται στην ανακοίνωση, «το Εκπαιδευτικό Συμβούλιο της Κεντρικής Σχολικής Περιφέρειας του Καρμέλ είναι συγκλονισμένο και καταδικάζει αυτά τα πρόσφατα βίντεο, καθώς και τον κατάφωρο ρατσισμό, το μίσος και την περιφρόνηση για την ανθρωπότητα που εκδηλώνονται σε ορισμένα από αυτά».

Ένας γονέας, η Αμπιγκαίηλ Λάιονς, δήλωσε ότι μια συνάδελφος, που έχει επίσης παιδιά στην περιοχή, τής έδειξε ένα κείμενο που περιείχε επτά διαφορετικά βίντεο.

«Τα έχασα», δήλωσε η Λάιονς, η οποία είναι μιγάς. «Ήταν φρικτό. Φαινόταν τόσο αληθινό.»

Επανεξετάζοντας τα βίντεο, παρατήρησαν ότι η κίνηση των χειλιών και η γλώσσα του σώματος ήταν λίγο διαφορετική από τον ήχο. Η Λάιονς δήλωσε ότι οι περισσότεροι γονείς στην περιοχή είχαν ήδη δει ή ακούσει για τα βίντεο και πιθανότατα γνώριζαν ότι επρόκειτο για deepfake πριν οι σχολικοί αξιωματούχοι του Καρμέλ αναγνωρίσουν δημοσίως το περιστατικό και δηλώσουν ότι «δεν υπήρχε καμία απειλή».

Η Λάιονς ανέφερε ότι το γεγονός τρόμαξε την κόρη της και ότι γεγονότα όπως το κλείδωμα των σχολείων ή οι ασκήσεις έκτακτης ανάγκης εξακολουθούν να προκαλούν άγχος και φόβο, που πηγάζουν από το 2023.

«Οι μαθητές της έβδομης τάξης δεν θα έπρεπε να ανησυχούν για αυτά τα πράγματα», δήλωσε στους Epoch Times.

Η Λάιονς δήλωσε ότι δεν γνωρίζει για κανένα περιστατικό deepfake μέχρι στιγμής αυτό το εξάμηνο, αλλά οι φοιτητές έχουν απειλήσει ο ένας τον άλλον στα μέσα κοινωνικής δικτύωσης, περιλαμβανομένης μιας απειλής που οδήγησε σε δίωρο κλείδωμα του κτιρίου.

«Ακόμα δεν ξέρουμε για ποιο λόγο έγινε [το κλείδωμα]», είπε. «Ακόμα δεν υπάρχει διαφάνεια.»

Οι Epoch Times απευθύνθηκαν στα περιφερειακά γραφεία στο Καρμέλ της Νέας Υόρκης και στην κομητεία της Βαλτιμόρης του Μέρυλαντ, αλλά δεν έλαβαν απάντηση.

Ο νέος νόμος της Καλιφόρνια προέκυψε μετά από διάφορα περιστατικά εμφάνισης deepfake με θύματα μαθητές.

Ο Πάτρικ Γκιττισριμπουνγκούλ, βοηθός επιθεωρητή για την τεχνολογία και την καινοτομία στην ενοποιημένη σχολική περιφέρεια Lynwood κοντά στο Λος Άντζελες, δήλωσε ότι η περιφέρειά του εφάρμοσε μια πολιτική μηδενικής ανοχής, που απαιτεί από το προσωπικό να ειδοποιεί τις αστυνομικές αρχές, να παρέχει φροντίδα στα θύματα και να αναπτύσσει ένα σχέδιο αντιμετώπισης περιστατικών ΤΝ.

Η περιφέρεια περιορίζει τη χρήση της ΤΝ, χρησιμοποιεί φίλτρα περιεχομένου για τις διαδικτυακές λειτουργίες και απαιτεί από τους μαθητές και το προσωπικό να ακολουθούν τις κατευθυντήριες γραμμές για τη ηθική χρήση της τεχνολογίας.

«Περιστατικά σε άλλες περιφέρειες της Νότιας Καλιφόρνια μάς ώθησαν να λάβουμε προληπτικά μέτρα», δήλωσε στους Epoch Times μέσω ηλεκτρονικού ταχυδρομείου. «Δεδομένης της ραγδαίας εμφάνισης της τεχνητής νοημοσύνης και της πιθανότητας κατάχρησής της, συντάξαμε μια ολοκληρωμένη πολιτική για να διασφαλίσουμε ότι η περιφέρειά μας είναι προετοιμασμένη να αντιμετωπίσει οποιαδήποτε μελλοντικά ζητήματα σχετικά με deepfake ή ακατάλληλο περιεχόμενο που παράγεται με τεχνητή νοημοσύνη.»

Το Κέντρο για τη Δημοκρατία και την Τεχνολογία ανέφερε τον περασμένο μήνα ότι το 40% των μαθητών και το 29% των εκπαιδευτικών γνώριζαν για deepfake που απεικονίζουν παιδιά ή ενήλικες που σχετίζονται με το σχολείο τους κατά τη διάρκεια του ακαδημαϊκού έτους 2023-2024.

Η έκθεση βασίζεται σε μια έρευνα περίπου 3.300 ερωτηθέντων από όλη τη χώρα, που εκπροσωπούν τις τάξεις 6-12 (περίπου το ελληνικό Γυμνάσιο και Λύκειο, Σ.τ.Μ.), συμπεριλαμβανομένων γονέων και εκπαιδευτικών. Το 38% θεώρησε το περιεχόμενο των deepfake προσβλητικό και το 33% το περιέγραψε ως πορνογραφικό.

Σύμφωνα με την έκθεση, οι περισσότεροι εκπαιδευτικοί δήλωσαν ότι δεν είχαν καταρτιστεί για τον ενδεδειγμένο τρόπο αντίδρασης στα deepfake και ότι οι περιφέρειές τους δεν είχαν επικαιροποιήσει την πολιτική τους για την αντιμετώπιση τέτοιου είδους περιστατικών.

Η έκθεση αναφέρει, επίσης, ότι οι περισσότεροι από τους εκπαιδευτικούς που συμμετείχαν στην έρευνα δήλωσαν ότι οι εργοδότες τους έχουν λάβει ελάχιστα μέτρα για την αντιμετώπιση της απειλής των deepfake. Λιγότερο από το ένα τέταρτο των ερωτηθέντων δήλωσαν ότι η λέξη deepfake έχει προστεθεί στην πολιτική σεξουαλικής παρενόχλησης της περιφέρειας ή στον κώδικα συμπεριφοράς των μαθητών.

Οι εκπαιδευτικοί προτιμούν κυρίως να απευθύνονται στις αστυνομικές αρχές για την επιβολή κυρώσεων στους δράστες των deepfake, έχοντας τη μακροχρόνια αποβολή ως δεύτερη επιλογή και τη συμβουλευτική ως τρίτη, σύμφωνα με την έκθεση.

Αντίθετα, οι γονείς δεν συμπεριέλαβαν καμία από αυτές τις ενέργειες στις τρεις πρώτες επιλογές τους. Πρώτη τους επιλογή, όσον αφορά όσους προέβαιναν για πρώτη φορά σε παρόμοια κακόβουλη ενέργεια, ήταν η ενημέρωσή τους σχετικά με τις επιβλαβείς επιπτώσεις των deepfake, αναφέρει η έκθεση. Δεύτερη επιλογή τους ήταν η παροχή συμβουλών και τρίτη η έκδοση προειδοποίησης.

Ρύθμιση της ΤΝ

Μια κοινοπραξία μη κερδοσκοπικών οργανισμών, περιλαμβανομένων της Εθνικής Οργάνωσης Γυναικών, του Ινστιτούτου Future of Life και του Κέντρου για την Ανθρώπινη-Συμβατή Τεχνητή Νοημοσύνη, ξεκίνησε φέτος την Εκστρατεία για την Απαγόρευση των Deepfake (CBD), μια παγκόσμια προσπάθεια ευαισθητοποίησης του κοινού.

Η CBD κυκλοφορεί ένα διαδικτυακό αίτημα για να υποστηρίξει την έκκλησή της για την ποινικοποίηση όλων των deepfake και την απόδοση ευθυνών στους προγραμματιστές τεχνολογίας και τους δημιουργούς περιεχομένου για τις πράξεις τους.

«Ο μόνος αποτελεσματικός τρόπος για να σταματήσουν τα deepfake είναι οι κυβερνήσεις να τα απαγορεύσουν σε κάθε στάδιο παραγωγής και διανομής», αναφέρει η CBD στην ιστοσελίδα της, όπου σημειώνεται ότι το deepfake σεξουαλικό περιεχόμενο αυξήθηκε κατά 400% και οι απάτες που σχετίζονται με deepfake κατά 3.000% μεταξύ 2022 και 2023.

«Δεν υπάρχουν νόμοι που να στοχεύουν και να περιορίζουν αποτελεσματικά τη δημιουργία και την κυκλοφορία των deepfake. Όλες οι τρέχουσες διατάξεις για τους δημιουργούς είναι αναποτελεσματικές», αναφέρει η CBD.

Νομική καθοδήγηση

Υπάρχει πληθώρα δωρεάν νομικών συμβουλών στο διαδίκτυο, τις οποίες οι σχολικές περιφέρειες μπορούν να χρησιμοποιήσουν για να προλάβουν την απειλή.

Μια εταιρεία από την Καλιφόρνια που ειδικεύεται στο εκπαιδευτικό δίκαιο – η Atkinson, Andelson, Loya, Ruud & Romo (AALRR) – δημοσίευσε οδηγίες σχετικά με τα deepfake, πριν από το ακαδημαϊκό έτος 2024-25, αναφέροντας τα περιστατικά στο Καρμέλ και την κομητεία της Βαλτιμόρης, καθώς και ένα περιστατικό στην πολιτεία της Ουάσιγκτον.

Στο τελευταίο, οι υπάλληλοι της περιφέρειας δήλωσαν ότι δεν κάλεσαν την αστυνομία μετά τη θυματοποίηση μιας μαθήτριας επειδή οι δικηγόροι τους τους είπαν ότι δεν ήταν υποχρεωμένοι να αναφέρουν «ψεύτικες» εικόνες.

Οι δικηγόροι της AALRR αρνήθηκαν να δώσουν συνέντευξη στους Epoch Times, αλλά η ιστοσελίδα της εταιρείας αναφέρει ότι οι περιφέρειες μπορούν να μηνυθούν για τη μη ικανοποιητική αντίδραση στα deepfake, βάσει νόμων που προϋπήρχαν της ΤΝ. Συμβουλεύουν τους διευθυντές των σχολείων να θεσπίσουν πολιτικές για την ΤΝ και να εκπαιδεύσουν τους μαθητές σχετικά με την υπεύθυνη και την καταχρηστική χρήση της ΤΝ.

Ακόμα δυσκολότερο είναι να εντοπιστούν και αντιμετωπιστούν ενέργειες που λαμβάνουν χώρα εκτός σχολικών χώρων, αλλά εξακολουθούν να επηρεάζουν τις σχολικές κοινότητες Κ-12. Τα όρια που διαχωρίζουν τις ευθύνες των γονέων από τις ευθύνες του σχολείου δεν είναι πάντα σαφή.

«Η κακόβουλη χρήση εκ μέρους των μαθητών του περιεχομένου που παράγεται από την ΤΝ πιθανόν να εγείρει ανησυχίες ανάλογες της Πρώτης Τροποποίησης», σημειώνει η ιστοσελίδα της AALR. «Ένα σχολείο που επιδιώκει να τιμωρήσει έναν μαθητή για κακόβουλη χρήση της ΤΝ εκτός σχολείου θα πρέπει να αποδείξει ότι η κακόβουλη χρήση της ΤΝ από τον μαθητή επηρέασε ουσιαστικά το σχολείο.»

Ενώ οι οργανισμοί προσπαθούν να εδραιώσουν έναν κοινωνικό κανόνα παγκοσμίως, εκατομμύρια μαθητές και σχολικοί υπάλληλοι παραμένουν ευάλωτοι.

Οι εκπαιδευτικές αρχές θα πρέπει να στοχεύσουν στην ευαισθητοποίηση σχετικά με τις βλάβες και τις συνέπειες των μιμήσεων που δημιουργούνται από την ΤΝ και να καταστήσουν σαφές στις σχολικές κοινότητες ότι η χρήση αυτής της αναδυόμενης τεχνολογίας για να βλάψει τη φήμη ενός άλλου ατόμου αποτελεί μορφή παρενόχλησης, αναφέρει ο Σηγκλ.

«Αφήστε τις αρχές επιβολής του νόμου να καταλάβουν αν πρόκειται για deepfake ή όχι», δήλωσε.