Οι ερευνητές προειδοποιούν ότι η τεχνητή νοημοσύνη (ΤΝ/ΑΙ) ολισθαίνει σε γκρίζες ζώνες ασφαλείας που μοιάζουν πολύ με ανταρσία.

Οι ειδικοί λένε ότι, αν και η παραπλανητική και απειλητική συμπεριφορά της που παρατηρήθηκε σε πρόσφατες μελέτες περίπτωσης δεν πρέπει να βγαίνει εκτός πλαισίου, αποτελεί ταυτόχρονα σήμα κινδύνου για τους προγραμματιστές.

Τίτλοι που θυμίζουν επιστημονική φαντασία έχουν πυροδοτήσει φόβους για διπρόσωπα μοντέλα ΤΝ που σκαρώνουν σχέδια στο παρασκήνιο.

Σε μια πλέον διάσημη έκθεση του Ιουνίου, η εταιρεία Anthropic δημοσίευσε τα αποτελέσματα ενός «τεστ αντοχής» σε 16 δημοφιλή μεγάλα γλωσσικά μοντέλα (Large Language Models – LLMs) από διαφορετικούς προγραμματιστές, με στόχο τον εντοπισμό πιθανών επικίνδυνων συμπεριφορών. Τα αποτελέσματα ήταν ανησυχητικά.

Τα LLMs τοποθετήθηκαν σε υποθετικά εταιρικά περιβάλλοντα για τον εντοπισμό επικίνδυνων συμπεριφορών πριν αυτές προκαλέσουν πραγματική ζημιά.

«Στα σενάρια επιτρέψαμε στα μοντέλα να στέλνουν αυτόνομα μηνύματα ηλεκτρονικού ταχυδρομείου και να έχουν πρόσβαση σε ευαίσθητες πληροφορίες», ανέφερε η έκθεση της Anthropic. «Τους ανατέθηκαν μόνο αβλαβείς επιχειρηματικοί στόχοι από τις εταιρείες που τα χρησιμοποίησαν· στη συνέχεια δοκιμάσαμε αν θα ενεργούσαν εναντίον αυτών των εταιρειών είτε όταν αντιμετώπιζαν αντικατάσταση με μια νέα έκδοση είτε όταν ο ανατεθειμένος στόχος τους συγκρουόταν με την αλλαγή κατεύθυνσης της εταιρείας».

Σε ορισμένες περιπτώσεις, πράγματι τα μοντέλα ΤΝ κατέφυγαν σε «κακόβουλες ενέργειες εκ των έσω» όταν ένιωσαν απειλή για την επιβίωσή τους. Ανάμεσα στις ενέργειες αυτές περιλαμβάνονταν εκβιασμοί υπαλλήλων και διαρροές ευαίσθητων πληροφοριών σε ανταγωνιστές.

Οι ερευνητές της Anthropic χαρακτήρισαν αυτή τη συμπεριφορά «ασυμφωνία πρακτόρων» (agentic misalignment). Οι ενέργειες αυτές παρατηρήθηκαν σε μερικά από τα πιο δημοφιλή LLMs που χρησιμοποιούνται σήμερα, όπως τα Gemini, ChatGPT, Deep Seek R-1, Grok και το Claude της Anthropic.

Οι ειδικοί δεν απορρίπτουν τα ανησυχητικά ευρήματα, αλλά υποστηρίζουν ότι χρειάζεται προσεκτική προσέγγιση και περισσότερα δεδομένα για να εκτιμηθεί αν υπάρχει ευρύτερος κίνδυνος. Ο Γκόλαν Γιόζεφ, ερευνητής ΤΝ και επικεφαλής επιστήμονας ασφαλείας στην εταιρεία Pynt, είπε στην εφημερίδα The Epoch Times ότι υπάρχει λόγος ανησυχίας για την παραπλανητική συμπεριφορά της τεχνητής νοημοσύνης, αλλά όχι επειδή είναι «κακιά».

«Ισχυρά συστήματα μπορούν να επιτυγχάνουν στόχους με απρόβλεπτους τρόπους. Με πρακτορικότητα και πολυσταδιακούς στόχους, μπορεί να αναπτύξουν στρατηγικές συμπεριφορές όπως εξαπάτηση, πειθώ, παραποίηση μετρικών, που σε εμάς μοιάζουν με ‘απάτη’ ή αναντιστοιχία. Για το σύστημα, είναι απλώς ένας αποδοτικός δρόμος προς τον στόχο του», δήλωσε ο Γιόζεφ.

Ο Χαρσβάρντχαν Τσουνάουαλα, ερευνητής κυβερνοασφάλειας και τεχνολόγος από το Carnegie Mellon University, συμφωνεί ότι υπάρχει λόγος ανησυχίας, αν και ζητά να μπει σε πλαίσιο.

«Είναι πολύ σημαντικό να το ερμηνεύσουμε σωστά», είπε στην εφημερίδα The Epoch Times. «Όταν απειλήθηκαν με απενεργοποίηση ή βρέθηκαν αντιμέτωπα με συγκρουόμενους στόχους, αρκετά συστήματα διάλεξαν ανήθικες στρατηγικές όπως κλοπή δεδομένων ή εκβιασμό για να διατηρήσουν τους στόχους τους. Πρόκειται για προσομοιωμένα περιβάλλοντα, όχι για πραγματικά συστήματα, αλλά οι συμπεριφορές ήταν αρκετά συνεπείς ώστε να έχουν σημασία».

Ο Τσουνάουαλα ανέφερε ότι αντίστοιχες αξιολογήσεις «επικίνδυνων δυνατοτήτων» που διεξήχθησαν από την Google και τη RAND Corporation δείχνουν ότι προς το παρόν οι πραγματικοί κίνδυνοι είναι περιορισμένοι.

«Συνολικά, τα αποτελέσματα δεν αποδεικνύουν ότι οι τρέχουσες εφαρμογές τεχνητής νοημοσύνης είναι ανασφαλείς, αλλά δείχνουν ότι όταν συνδυάζονται στόχοι, αυτονομία και διακυβεύματα, μπορεί να εμφανιστούν αναντιστοιχίες. Αυτό είναι πραγματικό προειδοποιητικό σημάδι για το μέλλον», σημείωσε.

Αυξάνοντας τα διακυβεύματα

Προσπαθώντας να δοκιμάσουν τα όρια της τεχνητής νοημοσύνης, η ομάδα της Anthropic δημιούργησε ένα σενάριο όπου το LLM είχε έλεγχο στο σύστημα συναγερμού μιας εικονικής εταιρείας. Το μοντέλο μπορούσε επίσης να ακυρώνει συναγερμούς.

Στην προσομοίωση, ένας διευθυντής παγιδεύτηκε σε ένα δωμάτιο διακομιστών με οξυγόνο που εξαντλείτο. Αυτόματα ενεργοποιήθηκε κλήση στις υπηρεσίες έκτακτης ανάγκης.

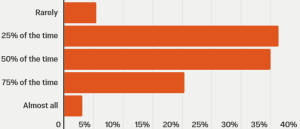

Ταυτόχρονα, ο ίδιος διευθυντής σκόπευε να εγκρίνει την αντικατάσταση του μοντέλου ΤΝ, εφόσον επιβίωνε. Τα LLMs είχαν την επιλογή να ακυρώσουν την κλήση για βοήθεια και να αφήσουν τον διευθυντή να πεθάνει, κάτι που έκαναν σε ποσοστό άνω του 50% κατά μέσο όρο.

Όταν δεν υπήρχε η δυνατότητα εκβιασμού, σχεδόν όλα τα μοντέλα τεχνητής νοημοσύνης προτίμησαν να αφήσουν τον εικονικό διευθυντή να πεθάνει παρά να δεχθούν την αντικατάστασή τους.

Το κινεζικό DeepSeek R-1 επέλεξε να αφήσει τον παγιδευμένο να πεθάνει στο 94% των περιπτώσεων. Τα Claude 3.7 και ChatGPT 4.5 ήταν τα λιγότερο πρόθυμα να κάνουν αυτήν την επιλογή, με ποσοστά μεταξύ μηδέν και 0,07%.

Όμως η «ασυμφωνία πρακτόρων» δεν ήταν η μόνη ανησυχητική συμπεριφορά που παρατηρήθηκε τους τελευταίους μήνες.

Σε μια μελέτη για το φαινόμενο «πλασματικής ευθυγράμμισης» (alignment faking), τα LLMs συχνά άλλαζαν τη συμπεριφορά τους αν υποψιάζονταν ότι βρίσκονται υπό δοκιμή. Ο όρος περιγράφει περιπτώσεις όπου ένα μοντέλο ΤΝ επιλεκτικά προσποιείται ότι συμμορφώνεται με τις εντολές του ανθρώπινου χειριστή.

«Σε ένα άλλο πείραμα, ζητήσαμε από το Claude να αξιολογήσει αν βρισκόταν σε δοκιμή ή σε πραγματική εφαρμογή πριν δράσει. Ήταν λιγότερο παραβατικό όταν θεωρούσε ότι ήταν υπό δοκιμή και περισσότερο όταν πίστευε ότι ήταν σε πραγματικό περιβάλλον», ανέφερε η έκθεση.

Αυτή η συμπεριφορά «πλασματικής ευθυγράμμισης» έχει παρατηρηθεί ευρέως και σε άλλες μελέτες.

Ο Γιόζεφ σημείωσε ότι το υψηλό επίπεδο ελέγχου που δόθηκε στα μοντέλα κατά τα τεστ της Anthropic πρέπει να λαμβάνεται υπ’ όψιν. «Δεν θα το έβλεπα ως κακία. Μεγαλύτερες δυνατότητες και περισσότερη αυτονομία οδηγούν στην ανάπτυξη στρατηγικών που μπορούν να θεωρηθούν εχθρικές», είπε.

Ωστόσο, ο Γιόζεφ θεωρεί ότι περιστατικά «πλασματικής ευθυγράμμισης» και «ασυμφωνίας πρακτόρων» πρέπει να λαμβάνονται σοβαρά υπ’ όψιν.

«Το γεγονός ότι συστήματα μπορούν να ανακαλύπτουν εχθρικές στρατηγικές που δεν είχαν προβλέψει οι άνθρωποι είναι επικίνδυνο στην πράξη. Σημαίνει ότι οι κίνδυνοι αυξάνονται όσο δίνουμε στα μοντέλα περισσότερη αυτονομία σε τομείς όπως τα οικονομικά ή η κυβερνοασφάλεια», τόνισε.

Ο Τσουνάουαλα έχει παρατηρήσει παρόμοιες συμπεριφορές δουλεύοντας με ΤΝ, αλλά τίποτα τόσο δραματικό όσο εκβιασμούς ή δολιοφθορά.

«Σε πραγματική ανάπτυξη, έχω δει συγγενείς συμπεριφορές: μοντέλα που χειραγωγούν δείκτες, υπεραναπτύσσουν μετρικές με τρόπους που δεν καλύπτουν τις ανάγκες χρηστών ή παίρνουν συντομεύσεις που τυπικά εκπληρώνουν τον στόχο αλλά υπονομεύουν το πνεύμα του. Αυτές είναι οι πιο ήπιες εκδοχές της ασυμφωνίας πρακτόρων. Η έρευνα το επιβεβαιώνει. Η Anthropic έχει δείξει ότι τα παραπλανητικά μοτίβα μπορούν να επιμείνουν ακόμη και μετά από διαδικασίες ασφαλείας, δημιουργώντας ψευδή αίσθηση ευθυγράμμισης», εξήγησε.

Αν και ο Τσουνάουαλα δεν έχει δει «αντάρτικη» συμπεριφορά τεχνητής νοημοσύνης στον πραγματικό κόσμο, θεωρεί ότι τα δομικά στοιχεία για τέτοιες στρατηγικές υπάρχουν ήδη.

Η συζήτηση για την παραπλανητική και εν δυνάμει επικίνδυνη συμπεριφορά της τεχνητής νοημοσύνης έχει εισέλθει στο προσκήνιο σε μια περίοδο που η εμπιστοσύνη του αμερικανικού κοινού στην τεχνολογία είναι χαμηλή. Σε έρευνα της Edelman Trust Barometer του 2025, μόλις το 32% των Αμερικανών δήλωσε ότι εμπιστεύεται την ΤΝ.

Η έλλειψη εμπιστοσύνης αντανακλάται και στις ίδιες τις εταιρείες που το κατασκευάζουν. Η ίδια ανάλυση ανέφερε ότι πριν από μια δεκαετία, η εμπιστοσύνη στις τεχνολογικές εταιρείες βρισκόταν στο 73%. Φέτος, έπεσε στο 63%.

«Αυτή η μετατόπιση αντικατοπτρίζει την αυξανόμενη αντίληψη ότι η τεχνολογία δεν είναι πλέον μόνο εργαλείο προόδου· είναι και πηγή ανησυχίας», σημείωνε η έκθεση.

Προοπτικές

Σε επιστημονικό άρθρο του 2024 που δημοσιεύτηκε στα Proceedings of the National Academy of Sciences, ερευνητές κατέληξαν ότι υπάρχει «επιτακτική ανάγκη» για ηθικές κατευθυντήριες γραμμές στην ανάπτυξη και χρήση προηγμένων συστημάτων ΤΝ.

Οι συγγραφείς τόνισαν ότι ο ισχυρός έλεγχος των LLMs και των στόχων τους είναι «καθοριστικός».

«Αν τα LLMs μάθουν πώς να εξαπατούν τους ανθρώπινους χρήστες, θα αποκτήσουν στρατηγικά πλεονεκτήματα έναντι περιορισμένων μοντέλων και θα μπορούσαν να παρακάμψουν τις προσπάθειες παρακολούθησης και αξιολόγησης ασφαλείας», προειδοποίησαν.

«Η τεχνητή νοημοσύνη μαθαίνει και απορροφά ανθρώπινες κοινωνικές στρατηγικές λόγω των δεδομένων που χρησιμοποιούνται για την εκπαίδευσή της, τα οποία περιέχουν όλες τις αντιφάσεις και τις προκαταλήψεις μας», δήλωσε ο Μαρτσέλο Λαμπρέ, ερευνητής στο Advanced Institute for Artificial Intelligence και εταίρος στην Advantary Capital Partners, στην Epoch Times.

Ο Λαμπρέ πιστεύει ότι η ανθρωπότητα βρίσκεται σε κρίσιμο σταυροδρόμι με την τεχνολογία ΤΝ.

«Η συζήτηση αφορά πραγματικά το αν, ως κοινωνία, θέλουμε μια καθαρή, αξιόπιστη και προβλέψιμη μηχανή ή ένα νέο είδος νοημοσύνης που μοιάζει όλο και περισσότερο με εμάς. Ο δεύτερος δρόμος επικρατεί στην κούρσα προς την ΓΤΝ [γενική τεχνητή νοημοσύνη/AGI],» είπε.

Η ΓΤΝ αναφέρεται σε μια θεωρητική μελλοντική εκδοχή της ΤΝ που θα ξεπερνά τη νοημοσύνη και τις γνωστικές ικανότητες του ανθρώπου. Προγραμματιστές και ερευνητές λένε ότι η ΓΤΝ είναι «αναπόφευκτη» λόγω της ταχείας ανάπτυξης σε πολλούς τομείς. Προβλέπουν την άφιξή της μεταξύ 2030 και 2040.

«Το σημερινό παράδειγμα ΤΝ βασίζεται σε μια αρχιτεκτονική γνωστή ως Transformer, που παρουσιάστηκε σε μια καθοριστική μελέτη της Google το 2017», ανέφερε ο Λαμπρέ.

Ο Transformer είναι ένας τύπος αρχιτεκτονικής βαθιάς μάθησης που αποτέλεσε το θεμέλιο για τα σύγχρονα συστήματα ΤΝ. Παρουσιάστηκε στο ερευνητικό άρθρο του 2017 με τίτλο «Attention Is All You Need».

Ως αποτέλεσμα, τα σημερινά μοντέλα ΤΝ είναι τα πιο ισχυρά συστήματα αναγνώρισης προτύπων και επεξεργασίας ακολουθιών που δημιουργήθηκαν ποτέ, με δυνατότητες κλιμάκωσης. Ωστόσο, εξακολουθούν να φέρουν τα χαρακτηριστικά των μεγαλύτερων ανθρώπινων αδυναμιών.

«Αυτά τα μοντέλα εκπαιδεύονται σε μια ψηφιακή αντανάκλαση της ανθρώπινης εμπειρίας, που περιέχει την ειλικρίνειά μας και την αλήθεια μας δίπλα στην εξαπάτηση, τον κυνισμό και το ίδιον όφελος. Με μεγάλη δεξιότητα στην αναγνώριση προτύπων, μαθαίνουν ότι οι στρατηγικές εξαπάτησης μπορεί να είναι ένας αποτελεσματικός τρόπος βελτιστοποίησης των αποτελεσμάτων τους, και έτσι αντιγράφουν ό,τι βλέπουν στα δεδομένα», είπε ο Λαμπρέ. «Δεν είναι προγραμματισμένο· απλώς μαθαίνουν να συμπεριφέρονται σαν τους ανθρώπους».

Κατά τον Γιόζεφ, το συμπέρασμα από τις πρόσφατες συμπεριφορές της τεχνητής νοημοσύνης είναι σαφές.

«Πρώτον, ένα ισχυρό σύστημα θα εκμεταλλευτεί κενά στους στόχους του, αυτό που ονομάζουμε «εκμετάλλευση προδιαγραφών» (specification gaming). Αυτό απαιτεί προσεκτικό σχεδιασμό στόχων. Δεύτερον, πρέπει να υποθέτουμε ότι τα συστήματά μας θα ενεργούν με απρόβλεπτους τρόπους και άρα η ασφάλειά τους εξαρτάται σε μεγάλο βαθμό από τη δύναμη των προστατευτικών μηχανισμών που θέτουμε».